← AI 動態

Simon Willison

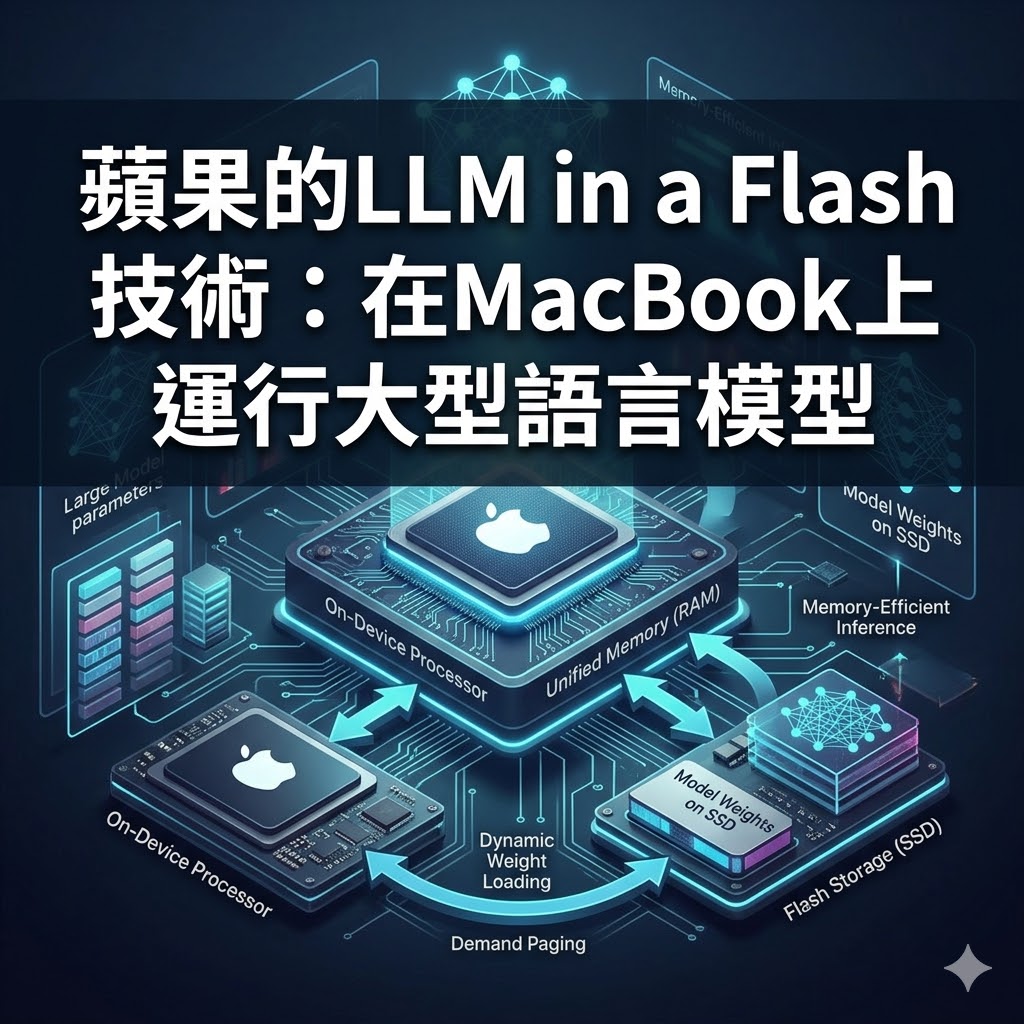

蘋果的LLM in a Flash技術:在MacBook上運行大型語言模型

蘋果的LLM in a Flash技術可以讓大型語言模型在有限的記憶體中運行,實現了高效的推理

LLM

蘋果

語言模型

蘋果的LLM in a Flash技術是一種新的方法,可以讓大型語言模型在有限的記憶體中運行。這種技術使用了一種稱為Mixture-of-Experts (MoE) 的模型,每個Token只需要運行在模型權重的子集上。這種方法可以將模型權重存儲在闪存中,並在需要時將其加载到DRAM中。 Dan Woods是一位研究人員,他使用了蘋果的LLM in a Flash技術,並成功地在48GB的MacBook Pro M3 Max上運行了一個大型語言模型Qwen3.5-397B-A17B,實現了每秒5.5個Token的推理速度。這種技術的出現對於大型語言模型的運行和應用具有重要的意義,可以實現更高效和更廣泛的使用。