M02.07|資料標註:教 AI 什麼是對、什麼是錯

AI 不是自學成才 — 每一個正確答案的背後,都有人類老師在標記

本講學習重點

監督式學習需要正確答案(label)讓模型學習

人工標註、半自動(模型預標+人工修正)、群眾外包

多人重複標註取共識、標註指南、抽樣審查

醫療影像每張$1-5美元、自駕車影像每幀$6-10美元

🎙️ Podcast(中文)

一句話搞懂

資料標註就是人類告訴 AI「這張照片裡的是貓」「這封郵件是垃圾信」— 沒有這些正確答案當老師,監督式學習的 AI 什麼也學不會。

白話解說

想像你在教一個完全不懂中文的外國人認字。你拿出一張寫著「大」的卡片說「這是 dà」,拿出「小」說「這是 xiǎo」。教了幾百個字之後,他開始能自己認出新的字了。

AI 的監督式學習也是同樣的過程。你要先準備一大堆「附帶正確答案的資料」— 這些正確答案就叫做標註(Label / Annotation)。圖片分類需要標記「這是貓/狗/鳥」、情緒分析需要標記「這則留言是正面/負面/中性」、物件偵測需要在圖片上畫框標出「這裡有一個行人」。

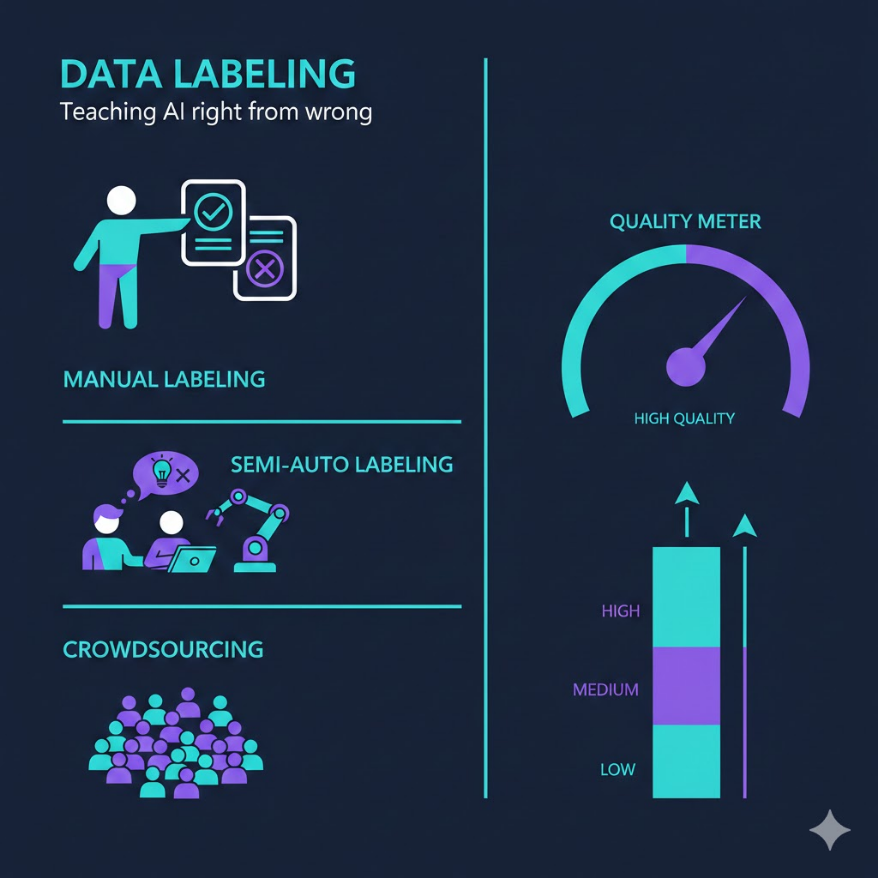

標註的方法有三種層級:

純人工標註:最傳統也最可靠。找一群人坐在電腦前,一張一張看圖片、一句一句讀文本,然後標記正確答案。優點是品質最高(如果標註者受過訓練的話),缺點是非常慢、非常貴。

半自動標註:先用一個粗糙的模型自動預標註(pre-labeling),然後讓人類來修正錯誤的部分。比如模型先自動框出圖片裡的物件,人類只需要調整框的位置和修正標籤。這可以提升 3-5 倍的標註效率。

群眾外包(Crowdsourcing):透過平台(如 Amazon Mechanical Turk)把標註任務分發給全球的兼職人員。優點是速度快、成本低;缺點是品質參差不齊,需要設計嚴格的品質控管機制。

標註最大的挑戰不是速度,而是一致性。同一張模糊的照片,甲標為「貓」、乙標為「狗」、丙看不出來標為「其他」。如何確保不同標註者的判斷一致?業界的做法是:(1) 撰寫詳細的標註指南(Labeling Guide),用大量範例說明邊界案例該怎麼標;(2) 多人重複標註,每筆資料至少讓 3 個人標,取多數決;(3) 定期抽樣審查,專家隨機抽查標註品質。

應用場景

場景:一家台灣醫療 AI 新創的影像標註流程

這家公司要做肺部 X 光的 AI 輔助判讀。標註流程的挑戰:

| 環節 | 做法 | 原因 |

|---|---|---|

| 標註者 | 只能用放射科醫師,不能用一般人 | 醫療影像需要專業知識判讀 |

| 標註指南 | 50 頁指南含 200 張範例影像 | 病灶邊界模糊,需要大量範例定義標準 |

| 品質控管 | 每張影像由 3 位醫師獨立標註 | 醫師之間的判讀差異(inter-rater variability)可達 10-15% |

| 共識機制 | 2/3 一致就採納,全部不一致就送主治醫師仲裁 | 減少主觀判斷的影響 |

| 成本 | 每張 X 光標註成本約 NT$150-300 | 醫師時間=高成本 |

| 規模 | 需要至少 50,000 張標註過的影像 | 模型才能學到足夠多的病灶模式 |

總標註成本:50,000 張 x NT$200 = NT$1,000 萬。這還不含醫師培訓、品質審查和重標的成本。這就是為什麼醫療 AI 的開發成本如此高昂。

常見誤區

-

「標註只要找便宜的工讀生就好」 — 取決於任務的專業度。分辨貓狗的標註確實不需要專家;但判斷 X 光裡有沒有腫瘤,你需要放射科醫師。台灣很多 AI 新創為了省成本用非專業人員標註醫療或法律資料,結果模型學到的是錯誤的標準。

-

「標註一次就永遠夠用」 — 標準會變。兩年前你的「客訴分類」只有 5 個類別,現在因為新產品線增加了 3 個類別,舊的標註就不完整了。資料的世界在變,標註也需要持續更新。

-

「大型語言模型(LLM)可以取代人工標註」 — LLM 確實可以協助標註(作為 pre-labeling 工具),但在高風險場景(醫療、金融、法律),LLM 的標註仍需要人類專家審核。GPT-4 自動標註的情緒分析準確率可能有 85%,但剩下 15% 的錯誤在金融合規場景可能造成嚴重後果。

小練習

-

標註指南設計:假設你要建一個 AI 模型來分類客戶留言為「正面」、「負面」、「中性」,請設計一份簡易的標註指南,至少包含:(a) 三個類別的定義、(b) 每個類別的兩個範例、(c) 兩個容易混淆的邊界案例及判斷標準。

-

標註成本估算:假設你要標註 10,000 張產品照片(分類為「合格」或「瑕疵」),每張標註需要 15 秒,時薪 NT$200。計算:(a) 需要多少人時?(b) 如果要求每張 3 人重複標註,總成本是多少?(c) 如果先用模型預標註可省 60% 的時間,成本變多少?