M02.09|資料偏誤:你的資料決定了 AI 的偏見

AI 不會歧視,但它會忠實地學會資料裡的歧視

本講學習重點

主要來自訓練資料中的歷史偏見和蒐集方式的系統性偏差

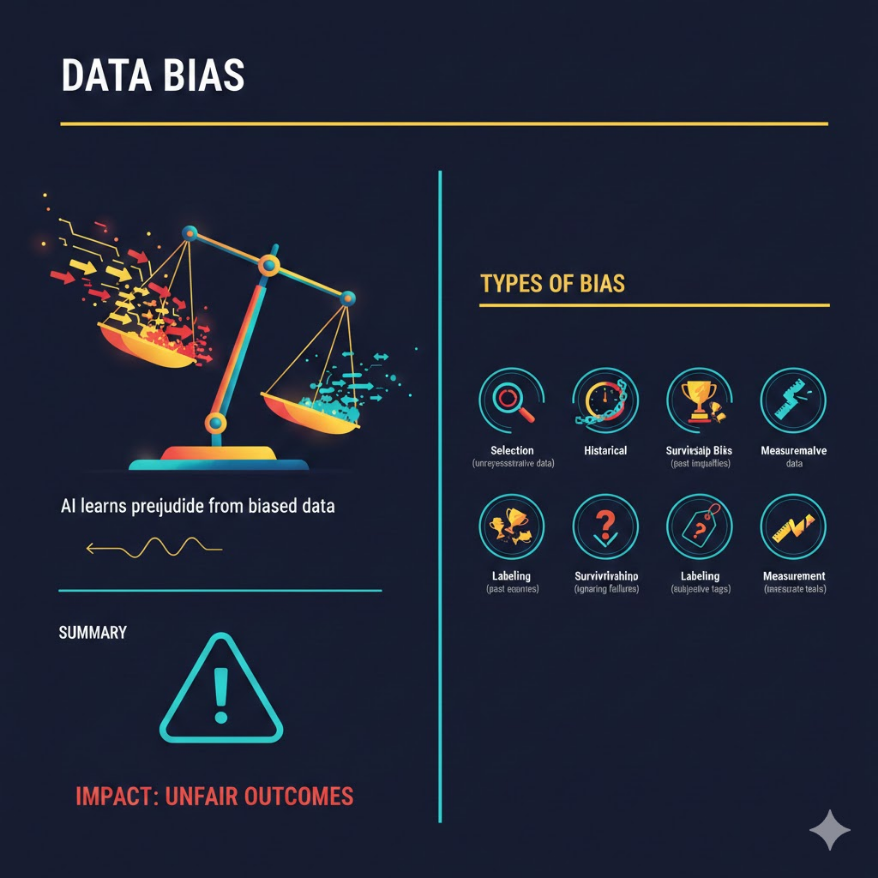

選擇偏誤、存活偏誤、標籤偏誤、歷史偏誤、測量偏誤

比較不同群組的模型表現、混淆矩陣分組分析

不能完全消除,但可以偵測、量化、緩解到可接受的程度

🎙️ Podcast(中文)

一句話搞懂

AI 不會自己產生偏見 — 它只是忠實地學會了訓練資料裡已經存在的偏見,然後用比人類更大的規模和速度把偏見散播出去。

白話解說

如果你只在台北市的餐廳吃飯,然後有人問你「台灣最好吃的小吃是什麼」,你的答案一定偏向台北。不是你故意偏心,而是你的「訓練資料」(吃飯經驗)就是偏的。AI 也是一樣 — 它的「見識」完全取決於訓練資料的內容。

資料偏誤有好幾種類型:

選擇偏誤(Selection Bias):訓練資料沒有公平地代表所有群體。例如你的人臉辨識模型只用了白人的照片來訓練,那它辨識亞洲人臉孔的準確率自然會很低。這不是模型的問題,是資料的問題。

歷史偏誤(Historical Bias):資料忠實地反映了歷史上的不公平。亞馬遜用過去十年的招聘資料來訓練 AI 篩選履歷,而過去十年錄取的多數是男性工程師,所以 AI 學到了「男性 = 好的候選人」。資料是「正確的」(確實反映了歷史),但學到的模式是「不公平的」。

存活偏誤(Survivorship Bias):只看到成功案例,看不到失敗案例。如果你用「成功上線的 AI 專案」的資料來分析成功因素,你就忽略了那些失敗的專案可能也有相同的因素 — 只是它們失敗了所以不在你的資料裡。

標籤偏誤(Labeling Bias):標註者的主觀偏見影響了標註結果。如果負責標註「攻擊性言論」的團隊全部是年輕男性,他們對「什麼算攻擊性」的標準可能跟其他群體不同。

測量偏誤(Measurement Bias):測量工具或方式造成的系統性偏差。例如某些地區的犯罪率看起來很高,但實際上只是那個地區的警察巡邏頻率更高,所以被記錄的犯罪案件更多。

應用場景

場景:一家台灣銀行的信用評分偏誤審查

某銀行的 AI 信用評分模型上線半年後,法遵部門發現一個問題:原住民客戶的核貸率明顯低於平均。深入調查發現了三層偏誤:

| 偏誤類型 | 具體問題 | 影響 |

|---|---|---|

| 歷史偏誤 | 過去 10 年原住民核貸率本就較低(歷史歧視) | AI 學到了「原住民 = 高風險」 |

| 測量偏誤 | 信用分數來源(聯徵中心)對無信用卡紀錄者不利 | 原住民地區信用卡普及率較低 |

| 選擇偏誤 | 訓練資料中原住民樣本只佔 1.5% | 模型對這個群體的學習不足 |

補救措施:

- 從模型輸入中移除「族群」和高度相關的代理變數(如「戶籍地區」)

- 增加原住民客戶的訓練樣本(過採樣)

- 設定公平性指標:各族群的核貸率差異不得超過 5 個百分點

- 建立定期偏誤審查機制(每季一次)

常見誤區

-

「只要不把性別、種族放進模型就不會有偏誤」 — 這叫「天真公平」(Fairness through Unawareness),通常無效。因為其他變數可能是性別或種族的「代理變數」(Proxy Variable)。例如「職業」和「郵遞區號」可能高度反映性別和族群分布,移除直接變數但保留代理變數,偏誤仍然存在。

-

「我們的資料是客觀的,所以不會有偏誤」 — 沒有資料是完全客觀的。資料的蒐集方式(誰的聲音被記錄?)、蒐集範圍(哪些地區?哪些族群?)、蒐集時間(哪個歷史階段?)都會引入系統性偏差。承認偏誤存在是解決偏誤的第一步。

-

「偏誤是技術問題,用演算法就能解決」 — 偏誤是社會問題在資料中的投射。你可以用技術手段(如重新採樣、公平性約束)來緩解,但不能單靠技術解決根源。一個完整的偏誤治理框架需要技術(偏誤檢測工具)+ 流程(定期審查)+ 人(多元化的團隊)+ 制度(明確的公平性標準)。

小練習

- 偏誤獵人:找出以下三個 AI 應用場景中最可能存在的偏誤類型,並說明可能的影響:

- (a) 用歷史犯罪資料訓練的犯罪預測系統

- (b) 用網路評論訓練的餐廳推薦 AI

- (c) 用醫院病歷訓練的疾病預測模型

- 公平性指標選擇:假設你的 AI 貸款審核模型有以下結果,判斷它是否公平:

- 男性申請者:核准率 70%、違約率 5%

- 女性申請者:核准率 55%、違約率 3%

- 思考:核准率不同代表不公平嗎?如果女性的違約率更低但核准率也更低,這合理嗎?