M05.06|圖像生成:Diffusion Model、DALL-E、Midjourney

從一堆雜訊中慢慢浮現一幅畫 — 這就是擴散模型的魔法

本講學習重點

擴散模型的核心邏輯(兩階段): - 前向過程:把乾淨圖片逐步加入高斯雜訊,直到完全變成純雜訊(約 1000 步) - 反向過程:訓練神經網路學習「每一步應該如何去除一點雜訊」 - 推理時:從純雜訊出發,反覆調用神經網路去雜訊,1000 步後得到乾淨圖片 - 文字引導:透過 CLIP 或 T5 編碼器將文字嵌入,在去雜訊的每一步中「導引」方向 三大主流平台比較: - DALL-E 3(OpenAI):與 GPT-4 深度整合,理解複雜語義最佳,提示遵循度高 - Midjourney:美學風格最強,預設出圖品質高,但閉源、只能透過 Discord 使用 - Stable Diffusion(Stability AI):開源,可本地部署,有龐大的微調模型社群 潛在擴散模型(LDM)的關鍵創新: - 把擴散過程從像素空間移到潛在空間(比像素空間小 8-16 倍) - 大幅降低計算成本,讓高解析度生成成為可能 - Stable Diffusion 就是 LDM 的實際應用 著作權現況: - 台灣:AI 生成物目前無著作權保護(著作人須為自然人) - 美國 USCO:純 AI 生成不受保護,但人類有顯著創作貢獻的部分可受保護 - 爭議:訓練資料是否侵犯原作者著作權(Getty Images vs Stability AI 訴訟進行中)

🎙️ Podcast(中文)

一句話搞懂

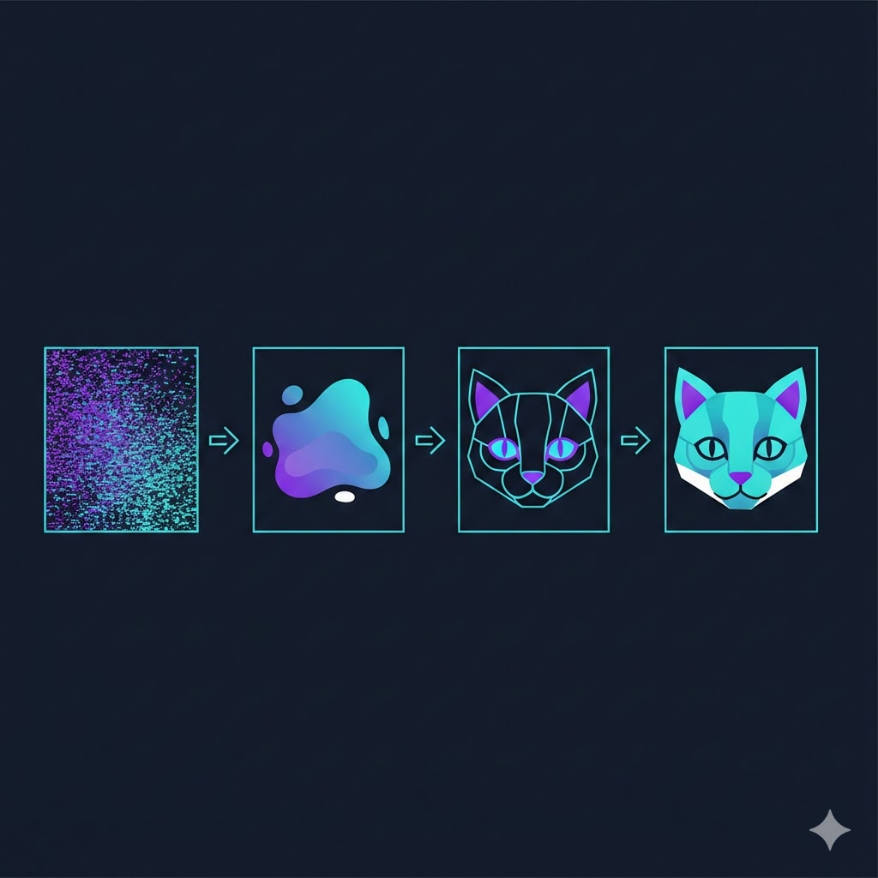

擴散模型(Diffusion Model)是目前主流的 AI 圖像生成技術——它先把圖片反覆加雜訊直到變成純雜訊,再訓練 AI 學習「如何一步步把雜訊還原成圖片」,推理時只需要從一堆隨機雜訊出發,就能生成任何文字描述的圖像。

白話解說

擴散模型的直覺:雕刻家的逆向思維

想像一個雕刻家在大理石上工作,他把一塊完美的雕像逐漸磨碎,最後變成一堆細沙——這是「破壞」的過程。擴散模型反過來問:如果我們對「破壞過程」的每一個步驟都瞭若指掌,是不是就能學會「如何從細沙重新雕出雕像」?

這正是擴散模型的核心邏輯。前向過程(Forward Process):取一張真實的訓練圖片,逐步向它加入微量的高斯雜訊,每一步讓圖片變得稍微模糊一點,重複約 1000 步,最終圖片完全淹沒在隨機雜訊中,變成一張看起來像電視雪花的畫面。反向過程(Reverse Process):訓練一個神經網路(通常是 U-Net 架構),學習「如何從第 t 步的雜訊圖,預測出第 t-1 步應該是什麼樣子」——也就是說,學習每一個去雜訊步驟的逆操作。訓練完成後,這個網路已經隱含了「什麼樣的圖像結構是合理的」的全部知識。

推理時,我們從一張完全隨機的雜訊圖出發,反覆調用這個神經網路進行去雜訊,一步一步讓圖像逐漸清晰成形。整個過程就像是從混沌中「召喚」出一幅畫,每次生成的結果都因初始雜訊不同而獨一無二。這個框架比 GAN 穩定得多,因為它的訓練目標明確(預測雜訊量),沒有 GAN 的「生成器與判別器互相博弈失衡」問題。

潛在擴散模型:讓高解析度生成成為可能

標準擴散模型有一個致命的效率問題:它在像素空間工作。一張 512×512 的圖片有 786,432 個像素,每一步去雜訊都要對這麼多像素做計算,1000 步下來計算成本極為驚人,在消費級 GPU 上完全不可行。

潛在擴散模型(Latent Diffusion Model,LDM) 是 2022 年 CompVis 實驗室提出的關鍵創新,Stable Diffusion 就是 LDM 的實現。它的解法是引入一個變分自編碼器(VAE):先把圖片壓縮到「潛在空間」(通常是原圖的 1/8 大小),在這個小得多的潛在空間裡做擴散過程,最後再用 VAE 的解碼器把潛在向量還原成高解析度圖片。這讓計算量減少了 64 倍以上,使得在一般消費級顯示卡(如 RTX 3080)上也能在幾秒內生成高品質圖像成為現實。

同年,OpenAI 的 DALL-E 2 和 Stability AI 的 Stable Diffusion 幾乎同時發布,加上 Midjourney 的崛起,2022 年成為 AI 圖像生成的元年。這三個系統都使用了 CLIP(Contrastive Language-Image Pretraining)作為理解文字的橋梁——CLIP 在大量圖文配對資料上訓練,能把文字描述和圖像內容對應到同一個語意空間,從而讓文字「引導」去雜訊的方向。

三大平台:各有千秋的圖像生成工具

目前商業上最主流的三個文生圖平台各自有鮮明的定位和技術特色:

DALL-E 3(OpenAI) 最大的優勢是語義理解能力。它直接整合到 ChatGPT,用戶用自然語言描述需求,ChatGPT 會自動優化提示詞再送給 DALL-E 3 生成。DALL-E 3 對文字細節的遵循度是三者中最高的,例如「在一張咖啡桌上放一個紅色咖啡杯,旁邊有一本打開的書,書頁上寫著 Hello World」,DALL-E 3 通常能準確呈現這些細節。其主要限制是閉源、按量計費,且生成風格相對「乾淨學術」。

Midjourney 是目前美學品質評價最高的平台。它不開源、只能透過 Discord 介面使用,底層技術刻意不透明,但它的預設出圖風格(精緻光影、藝術質感、高細節度)是許多設計師和藝術家的首選。Midjourney v6 後對文字提示的理解能力也大幅提升,但它仍然在「美學風格的把控」上表現最佳。

Stable Diffusion(Stability AI) 的核心優勢是開源與可控性。它可以在本地部署、無需支付 API 費用、支援自訂微調模型(LoRA)、支援 ControlNet(用草圖或姿態圖精確控制生成構圖)、支援 InPainting(局部修改)和 img2img(圖生圖)。龐大的社群在 Civitai 等平台上分享了數以萬計的微調模型,涵蓋各種藝術風格、人物風格、建築風格。這讓 Stable Diffusion 成為需要高度客製化控制的專業工作流的首選。

Prompt 工程:文生圖的隱藏技能

很多人第一次使用文生圖工具時都很失望——「我說想要一個夕陽下的沙灘,為什麼畫出來的看起來這麼普通?」原因在於,文生圖模型訓練時看過的圖文配對,通常是用非常具體的攝影術語、美術術語、風格術語標注的,而不是日常語言。

要得到高品質的結果,有效的 Prompt 通常包含幾個層次:主體描述(什麼、誰、在做什麼)、風格修飾(油畫、水彩、攝影、賽博龐克)、技術參數(8K 超高解析度、光線方向、景深、鏡頭焦距)、品質詞彙(masterpiece、highly detailed、award-winning photography)、藝術家風格引用(in the style of Monet、Studio Ghibli style)。Midjourney 還有 --ar(長寬比)、--v(版本)、--stylize(風格化程度)等參數;Stable Diffusion 則有「負面提示詞」(Negative Prompt,用來排除不想出現的元素)。

這催生了一個新的職業:Prompt 工程師——專門為特定業務場景設計、測試、優化圖像生成提示詞,形成可重複使用的提示詞範本,在電商、遊戲、廣告等行業有實際需求。

著作權迷霧:AI 圖像的法律灰色地帶

AI 圖像生成帶來了兩層著作權爭議,目前在全球範圍內都尚未有明確定論。

第一層:訓練資料問題。擴散模型是在數十億張從網路爬取的圖片上訓練的,其中包含大量有著作權的攝影作品和藝術作品,且訓練時通常未取得授權、未支付報酬。Getty Images 已對 Stability AI 提起訴訟,認為其侵犯了 Getty 的攝影著作權。藝術家社群的抗議更是持續不斷——有人開發了 Glaze 工具,讓藝術家在發布作品前加入微小的對抗性擾動,使圖像在人眼看來完全正常,但 AI 模型無法從中學到正確的風格特徵。

第二層:生成物著作權歸屬。由人類下提示詞、AI 生成的圖像,著作權究竟屬於誰?台灣《著作權法》明文規定「著作人」須為自然人(個人)或法人(公司),AI 本身不能成為著作人,而「使用 AI 工具」的人是否能主張著作權,目前著作權主管機關尚未有明確解釋。美國著作權局(USCO)在 2023-2024 年的系列裁決中確立:純 AI 生成的圖像不受著作權保護;但若人類在選擇、配置、調整上有「足夠的創意貢獻」(如精心設計的提示詞序列、後製整合),該部分可能受保護。

應用場景

| 應用領域 | 具體使用方式 | 推薦平台 | 主要考量 |

|---|---|---|---|

| 電商產品圖 | 快速生成多種角度和場景的產品展示圖,無需實體拍攝 | Stable Diffusion(本地部署,成本低) | 著作權清晰度、商業使用授權 |

| 廣告素材設計 | 生成廣告視覺草稿,讓客戶快速看到視覺方向,再由設計師精修 | Midjourney(美學品質高) | 品牌一致性、風格可控性 |

| 遊戲概念藝術 | 快速生成大量場景概念圖、角色設計草案,加速前期設計迭代 | Stable Diffusion + ControlNet | 風格一致性、構圖可控 |

| 新聞媒體配圖 | 為文章快速生成示意圖,標注「AI 生成圖片」 | DALL-E 3(語義準確) | 避免誤導讀者、清晰標示 |

| 室內設計方案 | 上傳平面圖,生成多種風格的室內效果圖供客戶選擇 | Stable Diffusion + img2img | 圖像保真度、風格控制 |

| 教育輔助教材 | 為課程生成說明性插圖、歷史場景復原圖 | DALL-E 3(語義精確) | 內容準確性、文化敏感性 |

| 個人化禮品 | 生成客製化圖案用於印製商品(馬克杯、T恤) | 各平台均可 | 商業使用授權需確認 |

常見誤區

誤區一:Prompt 越詳細,生成效果一定越好

很多初學者以為提示詞越長越詳細越好,結果卻發現塞滿了描述的提示詞反而讓模型「不知所措」,生成效果雜亂無章。實際上,文生圖模型的 Prompt 有「注意力競爭」的問題——每個詞都在爭奪模型的注意力資源,當詞彙過多時,後面的描述會被稀釋甚至忽略。有效的做法是:把最重要的元素放在提示詞前面(模型對前段的注意力更強),核心主體描述清楚但不過度,風格和技術詞彙精選幾個最關鍵的,寧可多次迭代調整,也不要一次塞入所有想法。Midjourney 有 :: 語法可以給特定詞彙加權,Stable Diffusion 的 AUTOMATIC1111 介面支援 (詞彙:1.5) 格式調整各部分的權重。

誤區二:AI 生成的圖像可以直接用於任何商業用途

三大平台的商業使用授權各不相同。Midjourney 免費版不允許商業使用,Pro 版才允許商業使用(且對年收入超過 100 萬美元的公司有額外限制)。Stable Diffusion 的基礎模型採用 CreativeML Open RAIL-M 授權,允許商業使用但禁止某些有害應用,但使用社群微調模型時,還需要查看各個模型作者的個別授權聲明。DALL-E 3 透過 API 使用時,OpenAI 的條款允許商業使用生成的圖像。此外,所有 AI 生成圖像在台灣法律下目前不受著作權保護,這既是優點(無需擔心 AI 版權)也是風險(他人可自由使用你的 AI 圖像)。在啟動大規模商業應用前,務必仔細閱讀各平台的最新服務條款。

誤區三:擴散模型生成的圖像一定包含藝術家的「原作風格」

雖然在提示詞中加入「in the style of 某藝術家」確實能讓生成結果帶有該藝術家的視覺風格,但擴散模型並未「複製」或「儲存」任何原始圖像——它儲存的是從數十億圖像中學到的統計規律,不是圖像本身。每次生成都是從雜訊中全新生成,不是拼貼或抄襲原有圖像。然而,這並不代表「風格引用在法律上完全沒有問題」——這是另一個層面的爭議(藝術家是否有權主張風格被模仿)。從技術層面說,模型不儲存原圖;從法律和倫理層面說,是否應尊重藝術家對風格使用的意願,是目前業界正在辯論的議題。

小練習

練習一:分析擴散模型的生成步驟

以下是一個描述,請依序排列擴散模型在訓練階段和推理階段的步驟,並說明「文字提示詞」在哪個環節發揮作用:

訓練階段的操作包含(順序待定):

- (A) 訓練神經網路預測每一步加入的雜訊量

- (B) 在乾淨圖片上逐步加入高斯雜訊,共約 1000 步

- (C) 用帶有標題的圖文資料集(如 LAION-5B)作為訓練素材

推理階段的操作包含(順序待定):

- (D) 把文字提示詞用 CLIP 或 T5 編碼器轉成向量

- (E) 生成一張完全隨機的雜訊圖作為起點

- (F) 反覆調用神經網路,每次去除一點雜訊,共約 50-100 步

- (G) 輸出最終的乾淨圖像

點擊查看參考答案

練習一:擴散模型生成步驟分析

**訓練階段正確順序:C → B → A** 1. **(C) 準備圖文資料集**:蒐集數十億張帶有文字描述的圖片(如 LAION-5B 資料集),這是訓練的原始素材。 2. **(B) 前向過程(加雜訊)**:對每一張訓練圖片,隨機選取一個時間步 t(1 到 1000 之間),直接用數學公式計算「加了 t 步雜訊後的圖片長什麼樣」(不需要真的跑 1000 步,可以一步直接計算),得到一張帶雜訊的圖片。 3. **(A) 訓練去雜訊網路**:把帶雜訊的圖片輸入 U-Net,讓它預測「這一步加入了多少雜訊」,用預測的雜訊與實際加入的雜訊計算損失,反向傳播更新權重。重複數億次。 **推理階段正確順序:D → E → F → G** 1. **(D) 文字編碼**:把用戶輸入的提示詞(如「一隻在夕陽下奔跑的金色拉布拉多犬,攝影風格,淺景深」)用 CLIP 或 T5 編碼器轉成一個高維向量,這個向量在去雜訊的每一步都會被注入(透過 Cross-Attention 機制),引導圖像往對應方向生成。 2. **(E) 初始化隨機雜訊**:從標準正態分布取樣一張純雜訊圖作為起點——每次取樣不同,所以每次生成結果都不一樣。 3. **(F) 反向去雜訊循環**:反覆調用訓練好的 U-Net(實際推理時通常用 DDIM 等加速採樣方法,只需約 20-50 步而非 1000 步),每次讓圖像稍微清晰一點,文字向量全程參與引導方向。 4. **(G) 輸出圖像**:最後用 VAE 解碼器(若是 LDM)把潛在向量還原成完整尺寸的圖像,輸出結果。 **文字提示詞的發揮位置**:在推理階段的 (D) 和 (F) 步驟。文字在 (D) 被編碼成向量,然後在 (F) 的每一步去雜訊中,透過 Cross-Attention 讓文字向量「引導」去雜訊的方向——讓模型偏向生成與文字描述相符的圖像結構。練習二:選擇適合的圖像生成工具

你的公司有以下三個圖像生成需求,請為每個需求推薦最適合的工具(DALL-E 3 / Midjourney / Stable Diffusion 本地部署),並說明理由:

需求 A:電商平台有 5000 件商品需要生成白底產品圖,每天需要持續大量生成,預算有限,且需要精確控制商品擺放角度。

需求 B:廣告公司需要為客戶的高端鐘錶品牌製作一系列宣傳圖,強調精緻質感和奢華氛圍,需要讓客戶在簡報中看了「驚豔」的第一印象。

需求 C:一家新聞媒體需要為每天發布的 20 篇文章即時配圖,要求圖片能精確呈現文章描述的具體場景(含特定細節),並透過現有 CMS 系統的 API 自動化觸發生成。