M06.02|AutoML 平台:讓機器自己選演算法、調參數

以前需要資料科學家做三個月的事,AutoML 三小時搞定

本講學習重點

AutoML 六大自動化步驟:資料預處理、特徵工程、演算法選擇、超參數調整、模型評估、集成學習

NAS (Neural Architecture Search):自動搜尋最佳神經網路結構

Vertex AI:Google 雲端服務,適合企業級部署

H2O AutoML:開源方案,可本地部署

DataRobot:商業平台,強調可解釋性與合規

AutoML 限制:黑箱問題、資料品質依賴、計算成本高、極端客製化困難

🎙️ Podcast(中文)

一句話搞懂

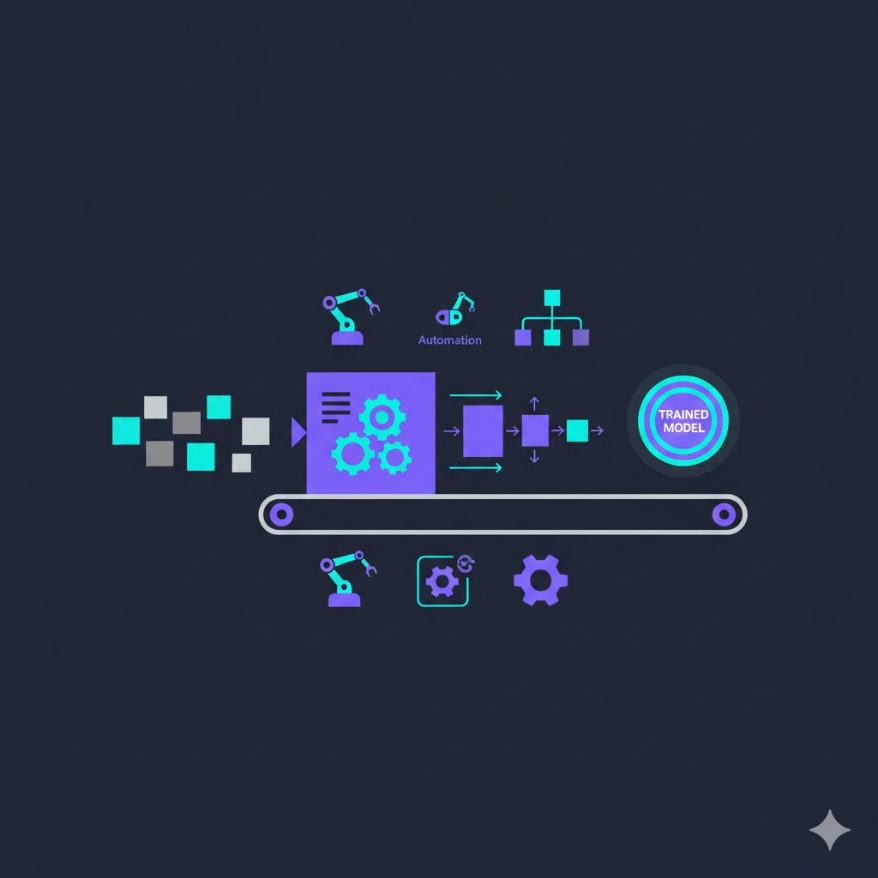

AutoML 是一個「把資料丟進去、好模型生出來」的自動化流水線——它代替你完成資料科學家原本需要數週才能完成的工作。

白話解說

傳統機器學習有多麻煩?

想像你要訓練一個「預測客戶是否會購買」的機器學習模型。傳統流程是這樣的:資料工程師先花兩週清理資料、補缺失值、去除異常值;資料科學家接著花一週做特徵工程(從原始欄位衍生出有用的新特徵);然後嘗試十幾種演算法——決策樹、隨機森林、XGBoost、神經網路……每種都要反覆調整幾十個超參數;最後再花一週評估、比較、挑選最佳模型並組合成集成模型。整個流程走完往往需要兩到三個月,還需要一位年薪百萬以上的資深資料科學家主導。

AutoML 把什麼事情自動化了?

AutoML(Automated Machine Learning,自動化機器學習)的目標,就是把上述流程中所有「需要人類判斷但又有明確優化目標」的步驟交給電腦自動完成。具體來說,AutoML 通常會自動處理以下六個環節:

- 資料預處理:自動偵測並處理缺失值、重複資料、異常值

- 特徵工程:自動從原始欄位衍生新特徵(如「星期幾」、「是否週末」、「與上次購買的間隔天數」)

- 演算法選擇:從候選演算法庫中自動選出最適合你的資料類型和任務的算法

- 超參數調整(Hyperparameter Tuning):透過貝葉斯優化、網格搜尋等技術找到最佳參數組合

- 模型評估:自動用交叉驗證評估每個候選模型的表現

- 集成學習(Ensembling):把多個性能較好的模型組合起來,進一步提升準確率

主流 AutoML 平台各有千秋

市面上的 AutoML 平台定位各有不同,選擇時需要根據組織的規模、技術能力和預算來判斷:

Google Vertex AI AutoML 是 Google Cloud 的 AutoML 服務,支援表格資料、影像、文字、影片四種資料類型,適合已使用 Google 雲端服務的企業。它的影像辨識 AutoML 能力尤其強大,在許多標準測試集上甚至超越了手動調整的模型。

H2O AutoML 是開源社群最受歡迎的 AutoML 工具之一,可以在本地伺服器或雲端執行,不需要月費。它特別擅長表格資料的預測任務,並且提供詳細的模型排行榜,讓你清楚看到每個演算法的比較結果。

DataRobot 是一個商業平台,特別強調模型的可解釋性(Explainability)和合規性,適合金融、保險等需要說明模型決策理由的受監管行業。

Azure Machine Learning 是 Microsoft 的雲端 ML 服務,與 Office 365 生態系整合良好,適合已深度使用 Microsoft 產品的企業。

神經架構搜尋:AutoML 的進階玩法

在深度學習領域,有一個更進階的 AutoML 技術叫做 NAS(Neural Architecture Search,神經架構搜尋)。它不只是調整超參數,而是連神經網路的「結構本身」都讓電腦自動設計——層的數量、每層的寬度、連接方式、激活函數的選擇,全部交由搜尋演算法決定。Google 用 NAS 設計的 EfficientNet 系列模型,在影像辨識任務上達到了人工設計架構難以企及的效率。目前 NAS 仍需要大量計算資源(Google 用了 450 個 GPU 跑了數天),但隨著成本下降,已逐步進入商業應用。

AutoML 也有它的侷限

儘管 AutoML 功能強大,它並非萬能。資料品質仍然是成敗關鍵——垃圾進去,垃圾出來(Garbage In, Garbage Out)。AutoML 無法解決你的資料本身就有偏差、標籤錯誤或代表性不足的問題。其次,AutoML 訓練過程通常像黑箱,你很難解釋模型為何做出某個決策,這在需要可解釋性的場景(如信用審核、醫療診斷)是嚴重的限制。最後,計算成本也不容忽視:AutoML 需要反覆訓練幾十甚至幾百個候選模型,雲端費用可能相當可觀。

應用場景

| 產業 | 任務類型 | 資料來源 | AutoML 任務 | 預期效益 |

|---|---|---|---|---|

| 零售業 | 需求預測 | 銷售歷史、天氣、節日 | 時間序列預測 | 降低庫存成本 15-30% |

| 金融業 | 信用評分 | 客戶財務紀錄、行為資料 | 二元分類 | 加速審核流程,降低呆帳率 |

| 製造業 | 設備預測性維護 | IoT 感測器數值 | 異常偵測 | 減少非計畫停機時間 |

| 醫療業 | 再入院預測 | 病患紀錄、檢驗結果 | 多類別分類 | 提早介入高風險病患 |

| 行銷業 | 客戶流失預測 | CRM 行為資料 | 二元分類 | 針對高風險客戶提前挽留 |

| 電商 | 商品分類 | 商品描述文字 | 文字分類 | 自動化商品目錄管理 |

常見誤區

誤區 1:「AutoML 輸出的模型一定比人工調整的差」

這個想法在幾年前或許還算合理,但現在已經不成立了。在 Kaggle(全球最大的機器學習競賽平台)上,使用 AutoML 工具(特別是 H2O AutoML 和 AutoGluon)取得的結果,已經能夠穩定地擊敗絕大多數手動建模的參賽者。在標準業務預測任務上,AutoML 模型的準確率通常與資深資料科學家手工調整的模型相差無幾,而且開發時間縮短了 90%。AutoML 的真正限制在於高度特殊化的任務,而非一般業務預測。

誤區 2:「只要有 AutoML,任何資料丟進去都能出好結果」

AutoML 自動化了「建模」的過程,但它無法自動化「理解業務問題」和「確保資料品質」這兩件最重要的事。如果你的訓練資料中,「已流失客戶」只有 1%(嚴重類別不平衡),或者你的標籤定義模糊(什麼叫「流失」?30 天沒消費算嗎?還是 90 天?),AutoML 算法無論多先進都無法救你。AutoML 是加速器,不是問題定義者,業務洞察仍然需要人來提供。

誤區 3:「AutoML 的模型部署就跟使用時一樣簡單」

許多使用者在 AutoML 平台上幾小時就訓練出了一個準確率不錯的模型,興奮地以為「完成了」,但實際上部署和維運才是更大的挑戰。模型需要包裝成 API 服務、整合到現有的業務系統、監控線上效能(模型漂移問題)、定期用新資料重新訓練。這些 MLOps(機器學習運維)工作即使使用 AutoML 訓練的模型,仍然需要一定的技術能力來處理。選擇 AutoML 平台時,要一起評估它的部署和監控功能,而不只是訓練階段的易用性。

小練習

練習 1:AutoML 適用性判斷

某電商公司有以下資料集和業務問題,請判斷哪些適合使用 AutoML,哪些不適合,並說明原因:

| 情境 | 資料描述 | 業務問題 |

|---|---|---|

| A | 過去五年,每日銷售紀錄 200 萬筆,含商品 ID、購買時間、客戶 ID、金額 | 預測下週各商品的銷售量 |

| B | 本月客服對話紀錄 500 筆,已人工標注「滿意/不滿意」 | 自動分類客服對話情緒 |

| C | 競爭對手網站的商品圖片(未授權使用) | 偵測我方商品是否被仿冒 |

| D | 招募問卷回覆 10,000 份,含姓名、年齡、學歷、薪資期望 | 預測哪些應徵者會接受 offer |

查看答案

**A. 非常適合** — 大量歷史時間序列資料、明確的預測目標、業務需求清晰。AutoML 的時間序列預測模組(如 Vertex AI Forecasting 或 H2O AutoML)可以直接處理此類任務。 **B. 勉強可試,但需注意** — 500 筆標注資料對 AutoML 文字分類來說偏少,可能準確率不理想。建議先嘗試,如果準確率 < 80% 就考慮增加標注資料量(至少 2,000 筆)或使用預訓練的情緒分析 API。 **C. 不適合,且有法律問題** — 使用未授權的競爭對手資料訓練模型可能涉及著作權和法律風險,這是在進行 AutoML 之前就需要解決的倫理與合規問題,技術工具無法解決。 **D. 技術上可行,但需謹慎** — 用「是否接受 offer」訓練模型技術上沒問題,但需注意:年齡、性別(若有)等欄位在招募決策中使用可能涉及歧視問題,需符合相關勞動法規。這是一個 AutoML 能做但不一定「應該做」的案例。練習 2:平台選擇邏輯

以下三個組織各有不同條件,請為每個組織推薦最適合的 AutoML 平台,並說明選擇理由:

組織 A:新創公司,沒有 IT 預算,技術團隊只有兩名工程師,需要快速建立一個客戶分群模型。

組織 B:大型保險公司,IT 基礎設施全部在 Microsoft Azure 上,需要建立核保風險評估模型,法規要求模型決策必須可解釋。

組織 C:大學研究室,需要在校內伺服器(不能使用雲端)上處理敏感的醫療資料,建立疾病預測模型。