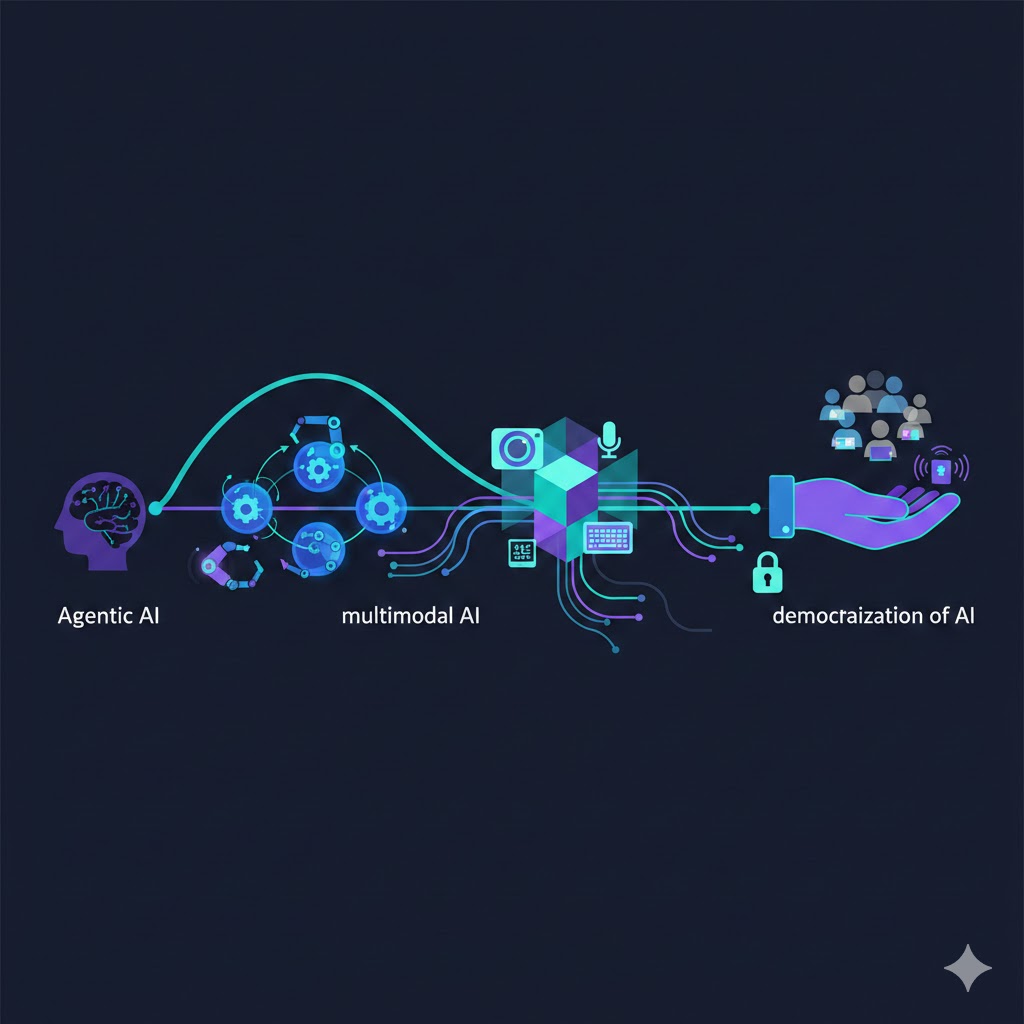

M10.09|AI 產業趨勢與未來:Agentic AI、多模態與 AI 民主化

AI 不再只是一個工具,它正在演化成一個能夠主動思考和行動的夥伴

本講學習重點

Agentic AI:能夠自主規劃、使用工具、執行多步驟任務的 AI 系統,代表從被動問答走向主動行動

多模態 AI:同時處理文字、圖片、影音、語音、表格等多種輸入,更接近人類的感知方式

AI 民主化:無需程式設計能力也能使用 AI(no-code/low-code),讓 AI 從少數專家工具變成大眾工具

SLM(Small Language Model):比 GPT-4 小 100 倍的語言模型,可在手機、邊緣裝置上執行,不需雲端

推理模型(Reasoning Model):如 o1/o3 系列,在回答前進行「思考鏈(Chain of Thought)」,大幅提升複雜推理能力

AI Agent 的五個核心能力:感知(Perceive)、記憶(Memory)、規劃(Plan)、工具調用(Tool Use)、行動(Act)

多智能體系統(Multi-agent):多個 AI 代理人分工合作,比單一 AI 更能處理複雜任務

🎙️ Podcast(中文)

一句話搞懂

AI 正在經歷三個同步發生的革命:Agentic AI 讓 AI 從被動回答問題進化到主動完成複雜任務;多模態 AI 讓 AI 能夠同時看、聽、讀,更接近人類的感知方式;AI 民主化讓不懂程式的人也能輕鬆駕馭 AI 的力量。這三個趨勢合流,正在把 AI 從一個「強大的搜尋引擎」轉化成一個「能替你辦事的智慧助理」。

白話解說

從「問答機」到「行動者」:Agentic AI 的革命

2022 年底 ChatGPT 的誕生,讓全世界見識到 AI 的對話能力——你問它什麼,它就回答什麼。這一代的 AI 是被動的:它只在被問到的時候才回應,完成一個對話就結束,無法主動採取行動改變外部世界。

但從 2024 年開始,AI 的典範正在快速轉移。Agentic AI(代理型 AI) 的核心特徵是自主性(Autonomy):它不只是回答問題,而是能夠接收一個高層次的目標,然後自己想辦法達成它——包括把大目標分解成步驟、決定每個步驟用哪個工具、執行行動、觀察結果、根據結果調整計畫。

一個具體的例子:你告訴傳統 AI 助理「幫我分析這個月的銷售資料」,它會回答「請把資料貼過來,我來分析」——它需要你一步一步餵給它輸入。但一個 Agentic AI 會自己去連接資料庫把銷售資料撈出來、呼叫資料分析工具做計算、生成圖表、起草一份報告、然後用 email 工具把報告寄給相關主管——在整個過程中,你只需要說「分析這個月的銷售並發送報告給主管」。

AI Agent 的五個核心能力:

- 感知(Perceive):從環境中獲取資訊(讀取檔案、瀏覽網頁、查詢資料庫)

- 記憶(Memory):短期記憶(當前對話的上下文)和長期記憶(儲存過去任務的結果供未來參考)

- 規劃(Plan):把複雜目標分解成可執行的步驟序列

- 工具調用(Tool Use):呼叫外部工具(搜尋引擎、計算器、API、程式執行器)

- 行動(Act):在真實世界採取可觀察的行動(寄送 email、填寫表單、執行程式碼)

多智能體系統(Multi-agent System)是 Agentic AI 的進階形式:不是一個 AI 包辦所有事,而是多個專業化的 AI 代理人分工合作。一個「研究型代理人」負責蒐集資料,一個「分析型代理人」負責解讀數據,一個「寫作型代理人」負責撰寫報告,一個「協調型代理人」(Orchestrator)負責分配任務和整合結果。這個架構讓 AI 能夠處理原本對單一 AI 來說太複雜的任務。

多模態 AI:AI 開始用所有感官認識世界

人類理解世界不只靠語言:我們看圖片、聽聲音、讀表格數字、感受情境。早期的 AI 系統是「單模態」的——文字模型只能處理文字,圖像模型只能處理圖像,語音模型只能處理聲音,它們各自獨立。

多模態 AI(Multimodal AI) 打破了這個隔閡,能夠同時理解和生成多種形式的資訊。GPT-4V、Gemini Ultra、Claude 3.5 Sonnet 都是代表性的多模態 AI,它們能做到:

輸入端的多模態理解:

- 給它一張產品照片,它能描述這個產品、識別品牌、估算價格

- 給它一段醫療影像,它能標記可疑區域並解釋診斷依據

- 給它一份 PDF 報表,它能閱讀圖表、提取數字、做跨頁比較

- 給它一段語音錄音,它能轉錄、翻譯、分析說話者的情緒

輸出端的多模態生成:

- 根據一段文字描述,生成符合要求的圖片(DALL-E 3、Midjourney、Stable Diffusion)

- 根據劇本,生成配音和配樂(如 Suno 作曲、ElevenLabs 配音)

- 根據指令,生成影片(Sora、Kling、Veo)

為什麼多模態很重要? 因為真實世界的業務問題幾乎都不是純文字的。工廠品管看的是圖片,醫療診斷看的是影像,合約審查看的是 PDF,客服對話可能是語音。多模態 AI 讓這些場景不再需要把所有輸入先轉換成文字再處理,可以直接以原始形式輸入,大幅降低了 AI 應用的技術複雜度。

AI 民主化:不寫程式也能用 AI

在 2020 年之前,真正用 AI 解決問題需要:懂 Python、理解機器學習原理、能設定和維護雲端基礎設施、有足夠的資料工程能力。這些門檻把大多數非技術背景的人擋在門外。

AI 民主化(AI Democratization) 指的是 AI 工具和能力的門檻大幅降低,讓更廣泛的人群能夠受益,不論技術背景。這個趨勢有幾個具體的表現:

No-code/Low-code AI 平台:像 Make.com(Integromat)、Zapier、n8n 這類工作流自動化平台,讓非技術人員能用拖拉介面把各種服務連接起來,並加入 AI 節點做智慧處理,完全不需要寫程式。

自然語言程式設計:GitHub Copilot、Cursor 等 AI 程式設計助理讓不熟練的程式設計師也能快速產出程式碼;更進一步,有工具讓你只需要用中文描述「我要一個能分析 Excel 並畫出折線圖的程式」,AI 就直接幫你生成可執行的程式。

SLM(Small Language Models,小型語言模型)的崛起:不是所有應用都需要 GPT-4 等級的大模型。Meta 的 Llama 3、Microsoft 的 Phi-3、Google 的 Gemma 等開源 SLM,可以在一般電腦甚至手機上本地執行。這意味著:

- 不需要把資料傳到雲端(資料隱私保護)

- 不需要支付高額的 API 費用

- 即使沒有網路連線也能使用(醫療現場、工廠車間、離島地區)

AI On-Device(裝置端 AI):Apple 的 Apple Intelligence、Google 的 Gemini Nano in Pixel、高通的 AI 晶片,讓手機本身就能跑語言模型,不需要每次呼叫雲端 API。這是隱私保護和即時性需求的重要進展。

推理模型:AI 開始「先想再說」

2024 年 OpenAI 發布的 o1 系列模型,以及後續的 o3、o1-mini,代表了另一個重要的技術演進:推理模型(Reasoning Model)。

傳統語言模型是「直接生成」的——輸入問題,直接輸出答案,就像一個人脫口而出第一個想到的答案。推理模型則是「思考後回答」的——在給出最終答案之前,模型會產生一段「內部思考(Chain of Thought)」過程,把問題分析清楚再回答,就像學生在解題時先打草稿再謄答案。

這個改變讓 AI 在複雜的數學、邏輯、程式設計、科學推理問題上的表現大幅提升。o3 在數學奧林匹亞競賽題和研究生等級的科學題目上,接近甚至超越了人類頂尖水準。

對 iPAS 考試來說,推理模型的關鍵考點是:它不是比傳統模型「更大」的模型,而是採用了不同的推論策略;它的計算成本比傳統模型高(因為要生成思考過程),適合需要高準確率的複雜推理任務,而不是所有任務都需要用推理模型。

具身智能與機器人:AI 走進物理世界

AI 的另一個重要前沿是具身智能(Embodied AI):讓 AI 不只在數位世界運作,而是控制有實體的機器人在物理世界行動。

Figure 01、Tesla Optimus、Boston Dynamics Atlas 等人形機器人,正在把大型語言模型的語言理解能力與機器人的運動控制結合。未來的工廠作業員、倉儲物流、家庭助理,可能有相當部分由能夠「聽指令、看環境、做動作」的具身 AI 機器人完成。

這個領域目前仍在快速發展中,iPAS 考試中的考點通常是概念理解層次:具身智能的定義、和純軟體 AI 的差異、以及在製造業、醫療、服務業的應用方向。

應用場景

| 趨勢 | 代表技術 | 近期應用案例 | 台灣產業機會 | 潛在風險 |

|---|---|---|---|---|

| Agentic AI | AutoGPT、LangGraph、CrewAI | 自動化業務報告生成、多步驟客戶服務 | 製造業流程自動化、金融業研究報告 | 自主行動難以監控、錯誤連鎖放大 |

| 多模態(視覺) | GPT-4V、Gemini Vision、Claude | 品質檢測、醫療影像輔助、零售貨架分析 | PCB 瑕疵檢測、電子製造品管 | 訓練資料偏差導致誤判 |

| 多模態(影音生成) | Sora、Kling、Stable Video | 廣告影片製作、教育影片自動化 | 媒體內容產業、教育科技 | Deepfake 濫用、版權爭議 |

| AI 民主化 / No-code | Zapier、Make、n8n、Dify | 中小企業流程自動化、個人生產力 | 傳統製造業的數位轉型入口 | 低品質 AI 應用泛濫、資安漏洞 |

| SLM / On-Device AI | Llama 3、Phi-3、Gemma | 手機端即時翻譯、工廠離線品管 | 隱私敏感的醫療、金融場景 | 小模型能力有限,容易在邊界情境出錯 |

| 推理模型 | o1、o3、DeepSeek-R1 | 複雜法律合約分析、高難度程式除錯 | 律師事務所、IC 設計電路驗證 | 計算成本高,延遲較長 |

| 具身智能 | Figure 01、Tesla Optimus | 倉儲搬運、組裝線輔助 | 半導體廠、電子代工廠 | 安全標準、事故責任歸屬 |

常見誤區

誤區 1:「Agentic AI 就是 AI 會自動化所有工作」

Agentic AI 的強大能力在媒體上常被誇大成「AI 要取代一切工作」。但實際上,目前的 AI Agent 在執行複雜、多步驟任務時仍然有重要的限制:可靠性(Reliability)問題——在長達幾十步的任務序列中,每一步都有一定的失敗概率,這些概率累積起來,整體任務成功率可能遠低於預期。一個每步成功率 95% 的 Agent,執行 20 步任務的整體成功率只有 0.95^20 ≈ 36%。

因此,現實中的 Agentic AI 部署通常採用「人在迴圈(Human-in-the-Loop)」設計:AI 執行可逆的、低風險的步驟,在關鍵決策點(如:送出付款、刪除資料、發布公告)時暫停並請求人類確認。完全自主的 AI Agent 目前更多是研究和概念驗證階段,企業真實部署時幾乎都有人類監督機制。

iPAS 考試常見的考題角度:如何在 Agentic AI 的「效率」和「可靠性/安全性」之間取得平衡?答案方向是:根據任務的風險等級設計不同程度的人類監督,而不是全自主或完全不用 Agent 的二選一。

誤區 2:「模型越大越好,用最新最大的模型就對了」

這個誤解在 LLM 剛興起時非常普遍:GPT-4 比 GPT-3.5 好,所以永遠用最新最大的。但 2024 年 SLM 的崛起和各種專用小模型的優秀表現,已經挑戰了這個假設。

選擇模型的正確框架是任務需求 × 資源限制 × 部署環境的匹配:

- 需要在工廠車間的邊緣設備即時判斷瑕疵?用 SLM,因為需要低延遲和離線能力,大模型的雲端 API 根本跟不上生產線速度

- 需要分析複雜的法律文件?用大型推理模型,因為準確率比速度更重要

- 需要每天處理數百萬個簡單的客服分類?用一個微調後的小模型,成本比呼叫 GPT-4 API 低 100 倍

選錯模型不只是效能問題,還是成本問題。用 GPT-4 做一個只需要 GPT-3.5 等級能力的任務,是一種資源浪費;相反,用一個太小的模型做複雜任務,錯誤率高到讓人無法信任,同樣是資源浪費。「剛好夠用的模型」是最好的模型。

誤區 3:「AI 發展太快,根本無法預測,學了也沒用」

這種「AI 發展太快學什麼都來不及」的焦慮,導致很多人陷入兩種極端反應:一是完全不學(反正學了也很快過時);二是焦慮地追逐每一個新工具(每週有新模型,每天學新東西,卻沒有積累真正有用的能力)。

正確的學習策略是分層學習:

- 底層原理(不過時):統計學習的基本概念、神經網路的運作原理、資料品質的重要性——這些在 10 年後仍然成立

- 中層框架(緩慢演進):如何評估 AI 系統的性能、如何設計 AI 產品的使用者體驗、如何進行成本效益分析——這些框架可以適應工具的更換

- 上層工具(快速更新):哪個 LLM 最新、哪個 Agent 框架最流行——這些確實會很快變化,但如果有了前兩層的基礎,學習新工具的速度會快很多

趨勢理解的意義不在於「預測哪個工具會贏」,而在於理解技術演化的方向(更自主、更多模態、更民主化),據此調整自己的技能組合和業務策略。

小練習

練習 1:趨勢應用情境分析

一家傳統的中型製造業公司(員工 500 人,主要生產消費電子零件),想在未來兩年內積極導入 AI。他們的 IT 部門只有 3 人,沒有資料科學家。

請針對以下三個 AI 趨勢,各舉出一個最適合這家公司優先導入的具體應用,並說明選擇理由: (A) AI 民主化 / No-code AI (B) 多模態 AI(視覺辨識) (C) 邊緣 AI / SLM On-device

練習 2:AI 趨勢辨識模擬考題

下列哪個描述最準確地說明了「Agentic AI」與「傳統 AI 助理」的核心差異?

(A) Agentic AI 使用的模型比傳統 AI 助理的模型更大、參數量更多 (B) Agentic AI 能夠自主規劃多步驟任務並調用工具執行,傳統 AI 助理主要回應單一輸入並給出單次回應 (C) Agentic AI 只能在雲端運行,傳統 AI 助理可以在本地設備上執行 (D) Agentic AI 不需要人類監督,可以完全自主地做出所有決策