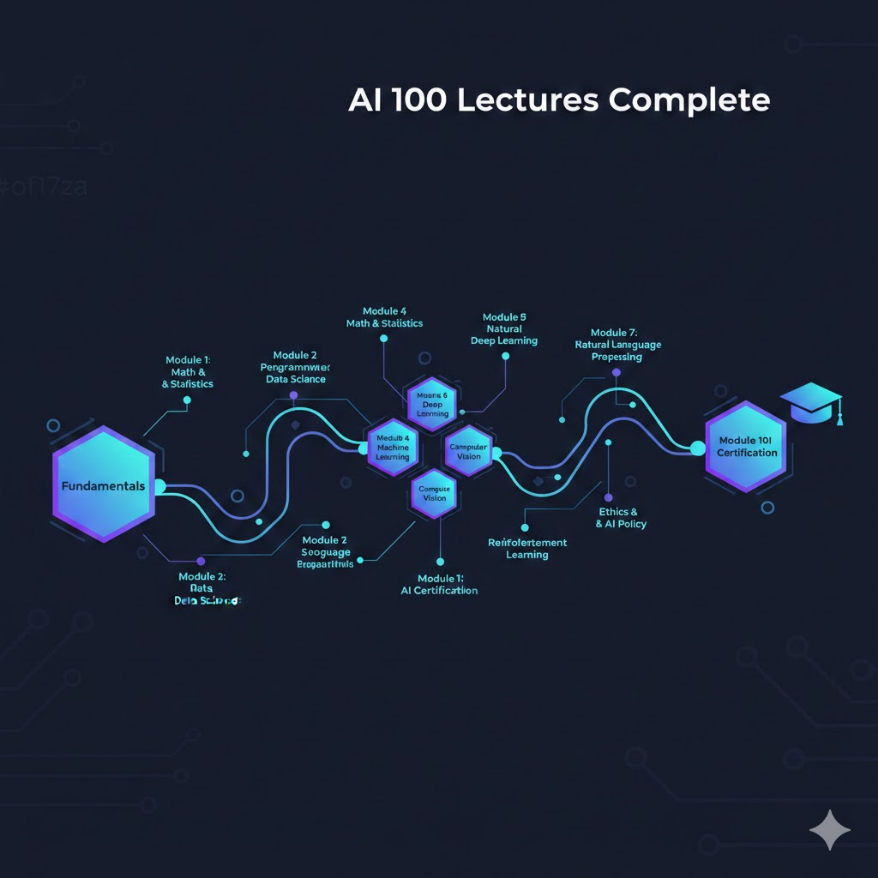

M10.10|總複習:AI 100 講知識地圖與 iPAS 考前衝刺

從第一講到第一百講——把 AI 的全貌裝進你的腦海,然後走進考場

本講學習重點

M01 AI 基礎:AI/ML/DL 三層架構,強/弱/超AI,圖靈測試,AI 發展史里程碑

M02 機器學習:監督/非監督/強化學習,過擬合/欠擬合,Bias-Variance Tradeoff,交叉驗證

M03 深度學習:神經網路結構,CNN/RNN/Transformer,反向傳播,批次正規化

M04 自然語言處理:Tokenization,Word2Vec,BERT,GPT,Prompt Engineering

M05 電腦視覺:影像識別,物件偵測(YOLO),語義分割,遷移學習

M06 生成式AI:GAN,VAE,Diffusion Model,幻覺問題,RAG

M07 AI 工具生態:主流框架(TensorFlow/PyTorch),MLOps,雲端 AI 服務

M08 大數據:5V,Hadoop/Spark,資料管線,特徵工程,資料品質

M09 AI 倫理與治理:偏見,公平性,可解釋性(XAI),隱私(差分隱私),法規(GDPR/AI Act)

M10 iPAS 實戰:產品設計思維,TCO/ROI,跨部門溝通,AI趨勢,Agentic AI

🎙️ Podcast(中文)

一句話搞懂

一百講走下來,你已經從「AI 是什麼?」走到了「如何設計、評估、部署、溝通、和反思 AI 系統」。現在是把這一切知識串成一張有機知識地圖的時候了——不是孤立地記住一個個知識點,而是看見它們之間的因果關係和相互影響,帶著這張完整的地圖走進考場,也走進你的工作和生活。

白話解說

一張圖看懂 AI 100 講的知識架構

整個課程的知識可以用一條「從問題到解方」的線索串起來:

[真實世界的問題]

↓

[資料收集與工程] (M08)

↓

[機器學習建模] (M02)

↓

[深度學習強化] (M03)

↓

[語言/視覺/生成能力] (M04, M05, M06)

↓

[工具與部署] (M07)

↓

[應用設計與管理] (M10)

↓

[倫理與治理] (M09)

↓

[持續的價值創造]

貫穿這條線索的基礎,是 M01 的 AI 核心概念——它是理解後面所有模組的共同語言。iPAS 考試的題目也常常跨越多個模組:一道關於「導入 AI 影像辨識做品質檢測」的題目,可能同時考到電腦視覺(M05)、資料品質(M08)、TCO(M10)、倫理中的偏見問題(M09)。

M01 AI 基礎——知識地圖的入口

M01 是整個課程的語言基礎。這裡的核心知識點,幾乎在每一個後面的模組都會用到:

三層架構:人工智慧(AI)> 機器學習(ML)> 深度學習(DL)。DL 是 ML 的子集,ML 是 AI 的子集,而不是三個並列的東西。

AI 能力分類:

- 弱人工智慧(Narrow AI):目前所有商業 AI 都屬此類,只能做特定任務

- 強人工智慧(AGI):能在任何認知任務上比肩人類,目前尚未實現

- 超人工智慧(ASI):超越人類,目前是理論概念

AI 的三個學習典範:監督式學習(有標籤資料)、非監督式學習(無標籤資料)、強化學習(獎勵信號)——這個分類框架在 M02 詳細展開。

iPAS 考點提醒:「機器學習」和「人工智慧」的關係,以及各種 AI 術語(如 AI 和 Expert System 的差異)是常見選擇題。

M02 機器學習——AI 的數學引擎

M02 是整個 AI 系統的核心引擎,幾乎所有 AI 應用的底層都是某種形式的機器學習。

最重要的三個概念:

1. 偏差-變異數權衡(Bias-Variance Tradeoff)

- 高偏差(高 Bias)= 欠擬合 = 模型太簡單,連訓練資料都學不好

- 高變異(高 Variance)= 過擬合 = 模型太複雜,記住了訓練資料的雜訊,無法泛化到新資料

- 目標:找到甜蜜點,讓訓練誤差和驗證誤差都合理

2. 模型評估指標

- 分類問題:準確率(Accuracy)、精確率(Precision)、召回率(Recall)、F1 Score、AUC-ROC

- 回歸問題:MAE、MSE、RMSE、R²

- 重要:在類別不平衡問題(如詐欺偵測,99%正常、1%詐欺)中,Accuracy 是誤導性指標,應用 F1 Score 或 AUC-ROC

3. 交叉驗證(Cross-Validation)

- K-Fold CV 是評估模型泛化能力的標準方法

- 訓練集/驗證集/測試集三分法的目的和邊界

M03 深度學習——讓 AI 看懂複雜模式

M03 是理解現代 AI 突破的技術核心。

CNN(卷積神經網路):專為處理有局部結構的資料設計(圖片、聲音頻譜),透過卷積核提取局部特徵,再透過池化壓縮空間維度。是電腦視覺的基礎架構。

RNN/LSTM(循環神經網路):專為序列資料設計(文字、時間序列),能記住前面的輸入資訊。但有梯度消失問題,LSTM 用門控機制解決了這個問題。

Transformer:2017 年 Attention Is All You Need 論文提出,用自注意力(Self-Attention)機制捕捉長距離依賴,並行運算比 RNN 快,是 BERT、GPT、Stable Diffusion 等幾乎所有現代大模型的基礎架構。

反向傳播(Backpropagation):神經網路訓練的核心算法,根據損失函數的梯度,反向更新每一層的權重。

M04 自然語言處理——讓 AI 讀懂人類語言

詞嵌入(Word Embedding):把詞語轉換成向量,讓語義相近的詞向量距離相近。Word2Vec、GloVe 是代表方法。

預訓練語言模型的演進:

- BERT(2018):雙向 Transformer,用「遮罩語言模型」任務在大量文字上預訓練,擅長理解(文本分類、命名實體識別)

- GPT 系列(2018-今):單向生成式 Transformer,擅長文字生成

- 現代 LLM(2022-今):GPT-4、Claude、Gemini 等,超大規模、多模態、指令微調

Prompt Engineering 的重要性:對生成式 AI 的輸出品質影響巨大,好的 Prompt 能讓模型表現大幅提升。Zero-shot、Few-shot、Chain of Thought 是三種核心提示技術。

幻覺(Hallucination)問題:LLM 可能生成聽起來很合理但實際上不正確的資訊。RAG(檢索增強生成)是目前最主流的解決方案,讓模型回答前先從知識庫搜尋相關資料。

M05 電腦視覺——讓 AI 看懂圖像世界

核心任務四分法:

- 圖像分類(Classification):「這張圖片是貓還是狗?」

- 物件偵測(Detection):「圖片中有哪些物件、在哪裡?」(YOLO、Faster R-CNN)

- 語義分割(Semantic Segmentation):「圖片中每個像素屬於哪個類別?」

- 實例分割(Instance Segmentation):更精細的分割,區分同類別的不同個體

遷移學習(Transfer Learning):使用在大型資料集(如 ImageNet)上預訓練好的模型,針對新任務進行微調(Fine-tuning)。大幅降低訓練資料需求量和計算成本,是企業實際部署電腦視覺最常用的策略。

M06 生成式 AI——讓 AI 創造內容

生成模型的三大架構:

- GAN(生成對抗網路):生成器和判別器對抗訓練,生成高品質逼真圖像

- VAE(變分自動編碼器):學習資料的潛在空間分佈,生成多樣化樣本

- Diffusion Model(擴散模型):學習反轉加雜訊的過程,是 Stable Diffusion、DALL-E 3 的基礎

RAG(Retrieval-Augmented Generation)的工作流程:

- 使用者提問 → 2. 向量資料庫搜尋相關文件 → 3. 把相關文件塞入 Prompt → 4. LLM 根據文件生成回答

M07 AI 工具生態——讓 AI 落地的技術棧

主流框架:TensorFlow(Google,部署友好)vs. PyTorch(Meta,研究友好),現在兩者都支援研究和生產部署。

MLOps 生命週期: 資料收集 → 特徵工程 → 模型訓練 → 評估 → 部署 → 監控 → 再訓練(循環)

MLOps 的目的是把 ML 開發的最佳實踐(版本控制、CI/CD、自動化測試)應用到 AI 系統,讓 AI 能夠可靠地在生產環境中持續運作。

模型部署方式:API 服務(REST API)、邊緣部署(ONNX Runtime、TensorRT)、Serverless(雲端 AI 服務)

M08 大數據——AI 的原材料工廠

5V 框架:Volume、Velocity、Variety、Veracity、Value。其中 Veracity(資料品質)是最容易被忽略但影響 AI 系統品質最深的一個。

資料管線(Data Pipeline):從資料源收集 → ETL(Extract, Transform, Load)→ 資料倉庫/資料湖 → 特徵工程 → 訓練資料

特徵工程的重要性:「垃圾進,垃圾出(GIGO)」。特徵的選擇和設計,往往比模型選擇對最終效能的影響更大。

M09 AI 倫理與治理——負責任的 AI

六大倫理原則(常見版本):公平性(Fairness)、透明性(Transparency)、可問責性(Accountability)、隱私性(Privacy)、安全性(Safety)、包容性(Inclusivity)

演算法偏見的來源:訓練資料中的歷史偏見、採樣偏差、標注者偏見、反饋迴路強化偏見

XAI(可解釋 AI)的主要方法:

- LIME:局部線性近似,解釋單一預測

- SHAP:基於 Shapley 值,量化每個特徵的貢獻度

- Saliency Map(顯著圖):視覺化神經網路關注了圖片的哪個部分

主要法規:歐盟 GDPR(資料保護)、歐盟 AI Act(AI 風險分級監管)、台灣個人資料保護法

M10 iPAS 實戰——把知識變成行動力

M10 把所有技術知識轉化為「能夠在組織中實際發揮作用的能力」:

- 產品設計思維:從使用者痛點出發,用 MVP 快速驗證假設,持續迭代

- 成本效益分析:TCO 完整估算(含隱性成本),ROI 計算(硬效益 + 軟效益),三情境分析

- 跨部門溝通:WIIFM 原則,類比法解釋技術,利害關係人矩陣,變革曲線管理

- 產業趨勢:Agentic AI(自主行動)、多模態(全感知)、AI 民主化(人人可用)

各模組重點回顧表

| 模組 | 核心主題 | 最重要的 3 個概念 | iPAS 高頻考點 |

|---|---|---|---|

| M01 AI 基礎 | AI/ML/DL 三層架構與 AI 類型 | 弱/強/超AI、三種學習典範、圖靈測試 | AI 與 ML 的關係、各術語定義 |

| M02 機器學習 | 從資料學習規律的方法論 | Bias-Variance Tradeoff、評估指標、交叉驗證 | 過擬合辨識、選對評估指標的情境題 |

| M03 深度學習 | 多層神經網路的強大表達能力 | CNN/RNN/Transformer 適用場景、反向傳播 | 各架構適用場景、Transformer 的優勢 |

| M04 自然語言處理 | 讓機器理解和生成人類語言 | BERT vs GPT 差異、Prompt 技巧、RAG | 幻覺問題與解法、Prompt Engineering |

| M05 電腦視覺 | 讓機器「看懂」圖像 | 四大任務定義、遷移學習、YOLO | 各任務差異、資料增強技術 |

| M06 生成式 AI | 讓機器「創造」內容 | GAN/VAE/Diffusion 差異、RAG 架構 | 生成模型架構辨識、RAG 工作流程 |

| M07 AI 工具生態 | 讓 AI 從實驗走進生產 | MLOps 生命週期、TF vs PyTorch、部署方式 | MLOps 各階段、CI/CD 在 ML 的應用 |

| M08 大數據 | AI 的原材料與基礎設施 | 5V 框架、資料管線、特徵工程 | Veracity 的重要性、批次 vs 串流 |

| M09 AI 倫理 | 負責任地開發和使用 AI | 六大倫理原則、偏見來源、XAI 方法 | 偏見情境題、法規適用、XAI 工具 |

| M10 iPAS 實戰 | 把技術轉化為組織價值 | MVP 設計、TCO/ROI、利害關係人管理 | 隱性成本識別、WIIFM 應用 |

小練習

練習 1(跨模組整合):AI 導入情境分析

一家台灣的銀行想導入 AI 信貸審核系統,自動評估個人貸款申請的核准與否。

請從以下五個角度,各指出一個最重要的考量:

(A) 機器學習角度(M02):選擇哪個評估指標?為什麼? (B) 倫理與治理角度(M09):最大的風險是什麼?如何緩解? (C) 成本效益角度(M10):最可能被忽略的隱性成本是什麼? (D) 溝通角度(M10):向法遵部門主任解釋 AI 系統時,最重要的訊息是什麼? (E) 趨勢角度(M10):未來這個系統最可能演化成什麼形態?

練習 2(iPAS 模擬考題組):綜合選擇題

題目 1:以下關於機器學習「過擬合(Overfitting)」的描述,何者正確? (A) 模型在訓練集上表現差,在測試集上表現也差 (B) 模型在訓練集上表現好,但在測試集上表現差 (C) 模型在訓練集上表現差,但在測試集上表現好 (D) 模型在訓練集和測試集上都表現很好

題目 2:企業導入 AI 客服系統時,以下哪個屬於「隱性成本」? (A) 系統軟體授權費用 (B) 伺服器硬體採購費用 (C) 員工從舊流程切換到新系統期間的生產力下滑 (D) 外部 AI 顧問公司的開發費用

題目 3:以下關於 RAG(Retrieval-Augmented Generation)技術的描述,何者最準確? (A) RAG 是一種訓練語言模型的方法,讓模型在訓練時就記住大量知識 (B) RAG 在推論時從外部知識庫搜尋相關資訊,提供給語言模型作為參考,以減少幻覺問題 (C) RAG 是指用多個不同的語言模型同時生成答案,再取最佳結果 (D) RAG 是強化學習的一個變體,用人類回饋來微調語言模型

題目 4:一個二元分類模型在測試集上的 Accuracy 達到 99%,但 F1 Score 只有 0.21。最可能的原因是什麼? (A) 模型發生了嚴重的過擬合 (B) 測試集資料的類別分佈極度不平衡(如 99% 負例、1% 正例) (C) 模型的學習率設定過高,導致訓練不穩定 (D) 訓練資料量太少,導致模型效能低落

題目 5:下列哪個選項最符合「AI 倫理中的可解釋性(Explainability)」原則? (A) 確保 AI 系統的訓練資料不包含任何個人資料 (B) 讓 AI 系統能夠說明做出特定決策的主要依據,讓使用者和受影響者能夠理解 (C) 要求 AI 系統的程式碼完全開源,供所有人審查 (D) 在 AI 系統的決策可能出錯時,自動停止運作並通知人類