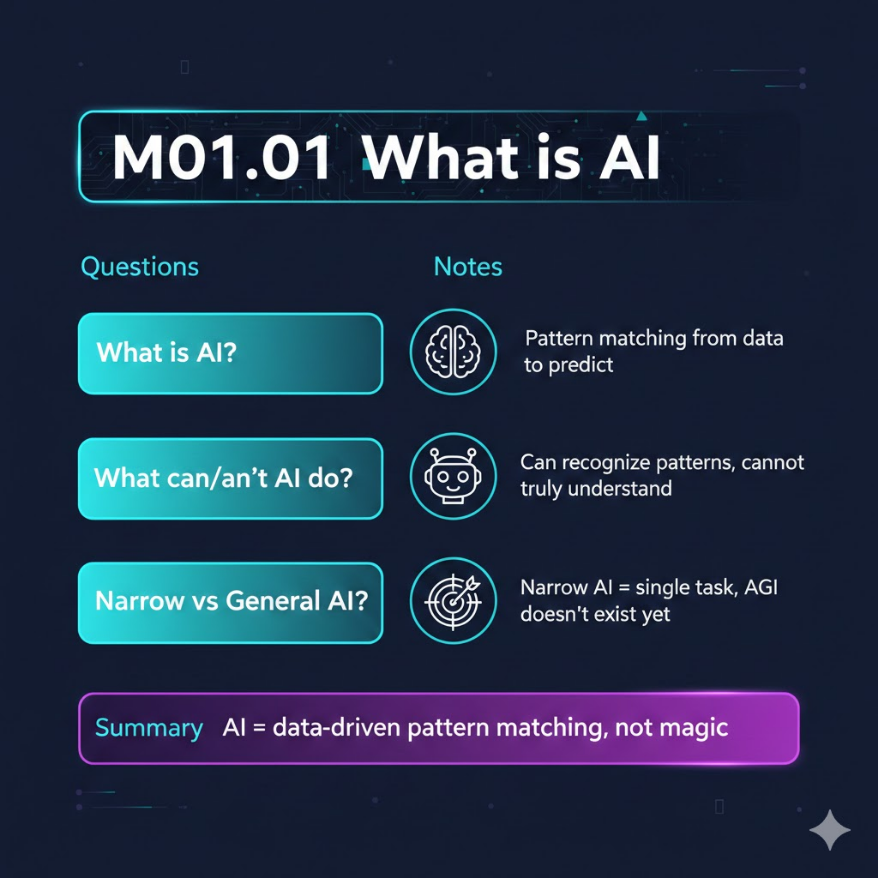

M01.01|什麼是 AI:定義、能力邊界與常見誤解

AI 就是「會從資料裡猜規則的程式」— 它不是魔法,也不是萬能

本講學習重點

從資料中自動找規律並預測的程式

能做模式辨識與預測,不能真正理解與推理

窄AI只做單一任務,通用AI目前不存在

🎙️ Podcast(中文)

一句話搞懂

AI 就是一種「能從大量資料中自動找出規律,然後用這些規律來做預測或決策」的程式。

白話解說

想像你公司新來了一位同事,他不是天才,但他有一個超能力:你丟給他一萬筆過去的銷售資料,他就能「猜出」下個月哪些客戶最可能下單。這位同事不會自己思考「為什麼」,他只是從資料裡歸納出規律,然後照著規律去猜。這就是 AI 在做的事情。

傳統的程式是工程師寫好規則,例如「如果溫度超過 30 度,就開冷氣」。AI 不一樣,它是反過來的:你給它很多「溫度和有沒有開冷氣」的歷史資料,它自己去學出規則。這就是為什麼我們說 AI 是「資料驅動」的 — 沒有資料,AI 什麼都做不了,就像那位新同事如果沒有歷史銷售報表,他也猜不出任何事。

目前我們日常接觸到的 AI 都屬於「窄 AI」(Narrow AI),也就是只能做特定任務的 AI:語音助理只會回答問題、推薦系統只會推薦商品、翻譯 AI 只會翻譯。至於電影裡那種有自我意識、什麼都會的「通用 AI」(AGI),目前還不存在。所以當有人說「AI 會取代所有工作」,其實是把窄 AI 跟通用 AI 搞混了。

應用場景

場景一:客服部門導入 AI 聊天機器人 一家電商公司想用 AI 聊天機器人處理客戶詢問。AI 能做到的是:根據過去幾萬筆客服對話紀錄,學會回答常見問題(物流查詢、退換貨流程)。但遇到客戶情緒激動的客訴、或是從未出現過的新型問題,AI 就會答非所問。正確的做法是讓 AI 處理 70% 的常見問題,把複雜情境轉給真人客服。

場景二:主管要求「用 AI 預測員工離職率」 HR 部門接到指令要預測哪些員工可能離職。AI 確實可以從過去的離職資料(年資、薪資成長、請假頻率等)中找出模式。但如果公司只有 50 個人、過去三年只有 5 個人離職,這個資料量根本不夠 AI 學到什麼有意義的規律。這時候用 AI 不如直接跟員工一對一面談。

常見誤區

-

「AI 就是機器人」 — AI 是軟體程式,不是實體機器人。你手機上的語音助理、Netflix 的推薦演算法都是 AI,但它們沒有手腳。機器人只是 AI 的其中一種「載體」,就像 App 只是軟體的一種呈現方式。

-

「AI 的答案一定是對的」 — AI 的本質是「統計上最可能的猜測」,不是「正確答案」。它會犯錯,而且犯錯的方式往往很有自信,看起來言之鑿鑿其實完全錯誤。這在生成式 AI 中尤其明顯,稱為「幻覺」(Hallucination)。

-

「AI 會理解我的意思」 — 目前的 AI 不具備真正的「理解」能力。它是在做複雜的模式比對,不是在「思考」。當你跟 ChatGPT 對話時,它是根據訓練資料中的統計規律來產生回應,而不是真的懂你在說什麼。

小練習

-

分辨練習:列出你工作中使用的三種工具或服務,判斷哪些有用到 AI、哪些只是傳統程式。提示:Excel 的 SUM 函數是傳統程式,但 Excel 的「自動建議圖表類型」可能用了 AI。

-

能力邊界思考:你的部門有一個反覆出現的問題想用 AI 解決。請回答以下三個問題:(a) 這個問題有沒有足夠的歷史資料?(b) 這個問題的答案是否有明確的對錯?(c) 如果 AI 猜錯了,後果嚴不嚴重?這三個問題能幫你初步判斷 AI 是否適用。