M01.03|AI 治理是什麼:為什麼不是只有法務要懂

AI 治理就像食品安全標準 — 不是廚師不用管,而是每個環節都要管

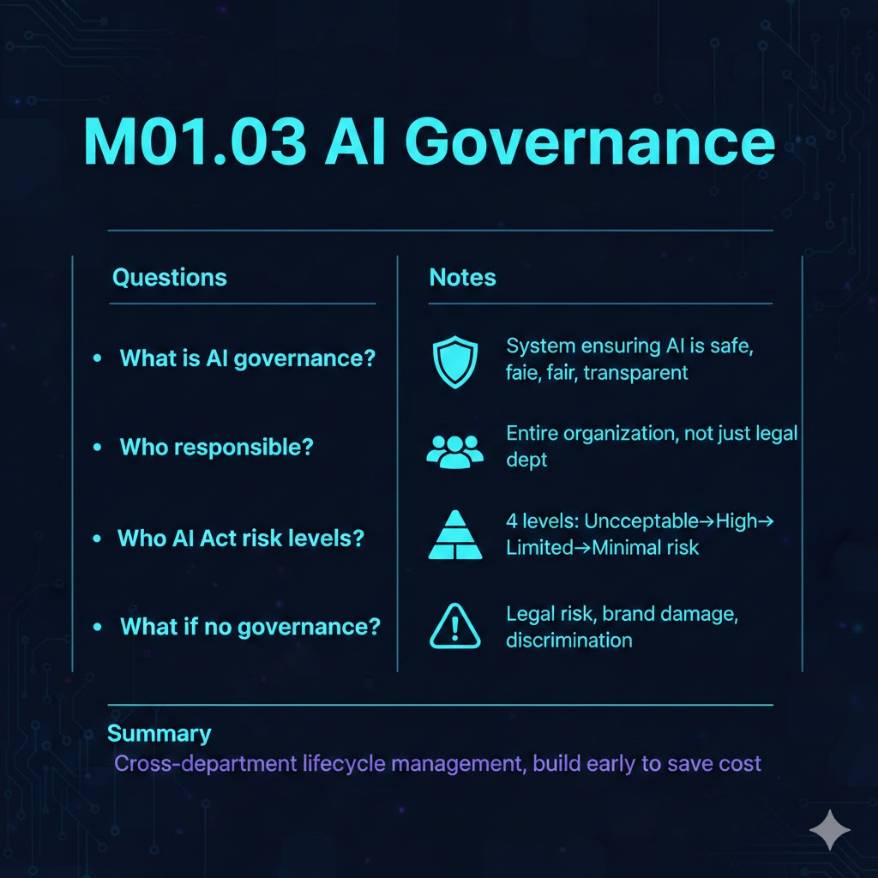

本講學習重點

確保AI被安全、公平、透明使用的制度與流程

全公司跨部門共同負責,不是只有法務

四級:不可接受、高風險、有限風險、最低風險

法律風險、品牌信譽毀損、歧視與偏見傷害

🎙️ Podcast(中文)

一句話搞懂

AI 治理就是一套確保「AI 被安全、公平、透明地開發和使用」的制度與流程,就像食品安全標準確保每一口食物都不會出問題。

白話解說

想像一下食品安全。食安不是只有衛生局的事:農場要管農藥殘留、工廠要管製程衛生、物流要管冷鏈溫度、餐廳要管食材保存、消費者要會看有效期限。如果只有衛生局在管,其他環節都不在乎,食安一定會出事。AI 治理的道理完全一樣。

AI 治理不是一份文件或一條法規,而是一整套「從開發到上線到退場」的管理機制。它回答的是這些問題:這個 AI 用了什麼資料來訓練?訓練資料有沒有偏見?AI 做出的決策能不能被解釋?出了問題誰負責?使用者知道他在跟 AI 互動嗎?這些問題如果沒人管,等到出事(例如 AI 面試系統被發現歧視女性應徵者),公司面臨的不只是法律風險,還有品牌信譽的毀滅性打擊。

歐盟已經通過了全球第一部 AI 專法《AI Act》,根據風險等級將 AI 應用分為四級:不可接受的風險(禁止使用,例如社會評分系統)、高風險(需嚴格合規,例如信用評分、人資篩選)、有限風險(需揭露,例如聊天機器人要告知使用者這是 AI)、最低風險(自由使用,例如垃圾郵件過濾)。台灣雖然還沒有類似立法,但金管會、國發會已經陸續發布 AI 應用指引,企業提早建立治理框架是明智之舉。

應用場景

場景一:HR 部門用 AI 篩選履歷 人資主管導入了一套 AI 履歷篩選系統,希望加快招募速度。上線三個月後,有人發現進入面試的候選人中,女性比例明顯偏低。調查後發現,這套 AI 是用過去五年的錄取資料來訓練的,而過去五年該公司本來就偏好錄取男性。AI 忠實地「學會」了這個偏見。如果有治理機制,在上線前就會要求做公平性測試(例如檢查不同性別的通過率是否有統計顯著差異),這個問題就能在造成傷害之前被發現。

場景二:銀行用 AI 決定貸款核准 一家銀行用 AI 模型來決定是否核准個人信貸。金管會來查,問了三個問題:(1) 這個模型拒絕某位客戶的理由是什麼?(2) 模型有沒有因為客戶的居住地區(可能間接反映種族或社經地位)而歧視?(3) 客戶有沒有申訴管道?如果銀行答不出來,就是治理失敗。

常見誤區

-

「AI 治理是法務和合規部門的事」 — 治理是全公司的事。資料工程師要確保訓練資料乾淨無偏見,產品經理要設計使用者告知機制,業務部門要能解釋 AI 的決策給客戶聽,IT 部門要確保模型的安全性。只靠法務寫一份政策文件,根本無法落實。

-

「我們公司很小,不需要 AI 治理」 — 公司大小不是重點,風險高低才是。即使是 10 人新創,如果你的產品用 AI 來決定誰能看到什麼內容、誰能獲得什麼服務,你就需要治理。而且越早建立基本框架,未來擴大時的改造成本越低。

-

「有了 AI 治理就不會出事」 — 治理框架是降低風險,不是消除風險。就像有食安標準還是會有食物中毒事件。治理的價值在於:(a) 降低出事的機率 (b) 出事時能快速找到原因 (c) 有標準流程來處理問題 (d) 向監管機關證明公司已盡合理注意義務。

小練習

-

風險分級練習:根據歐盟 AI Act 的四級風險分類,判斷以下 AI 應用各屬於哪一級:(a) 用 AI 自動批改小學數學作業 (b) 用 AI 分析求職者的面部表情來判斷是否錄取 (c) 用 AI 推薦 YouTube 影片 (d) 用 AI 即時評估公民的「社會信用分數」。

-

治理檢查清單:假設你的部門明天要上線一個 AI 客服機器人,請列出至少五個你認為上線前應該確認的治理項目。例如:「使用者是否知道自己在跟 AI 對話?」請盡量從不同角度思考(技術、法律、使用者體驗、公平性)。