M04.10|深度學習的局限與未來:不是所有問題都需要深度學習

深度學習很強,但它不擅長小數據、要解釋、要推理的場景

本講學習重點

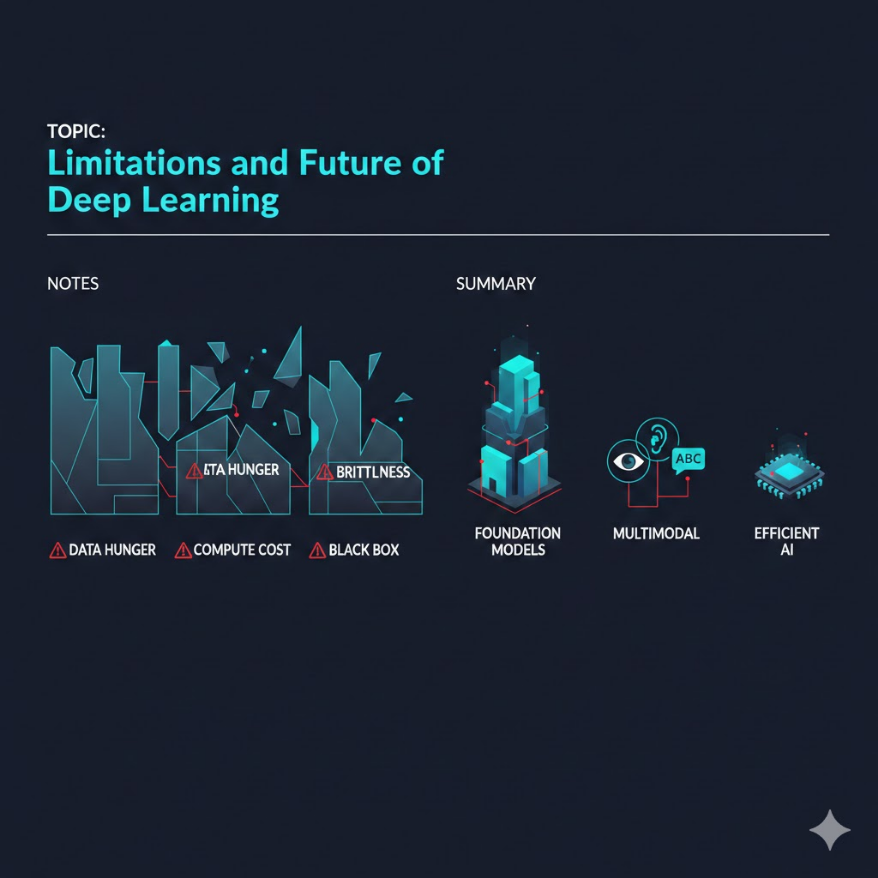

深度學習的五大核心局限: 1. 資料饑渴(Data Hunger): - 大型 DL 模型需要大量標注資料才能有效學習 - 稀少標注資料的場景:醫療罕見疾病、工業特殊瑕疵、法律判決 - 替代方案:傳統 ML(SVM、RandomForest)、遷移學習、Few-shot Learning 2. 計算資源昂貴(Compute Cost): - 訓練大型模型需要大量 GPU 時間和電力 - 碳排放:GPT-3 訓練約 552 噸 CO₂ - 推論也消耗大量資源(每次 ChatGPT 對話估計費用 0.01–0.04 美元) 3. 黑盒問題(Black Box): - 很難解釋「為什麼」做出特定預測 - 高風險決策場景:貸款拒絕、醫療診斷、法院判決 → 必須能解釋 - 替代方案:決策樹、邏輯回歸、規則引擎(可解釋性高) 4. 脆弱性(Brittleness / Distribution Shift): - 訓練資料和測試資料分布不同時,效能急速下降 - 對抗性攻擊(Adversarial Attack):微小的輸入擾動讓模型完全出錯 - 醫院 A 的資料訓練的模型,在醫院 B 的設備上效能可能差很多 5. 缺乏因果推理(No Causal Reasoning): - 深度學習學習的是統計相關性,不是因果關係 - 「冰淇淋銷量和溺水事故相關」→ DL 可能學到,但推論出錯誤因果 - 無法回答反事實問題(Counterfactual):「如果我不服藥,會發生什麼?」 未來趨勢: - 基礎模型(Foundation Models):超大規模預訓練,適應各種下游任務 - 多模態 AI:文字、圖像、音訊、視訊、感測器資料的統一模型 - 高效 AI:模型蒸餾、量化、稀疏化,讓 AI 在小裝置上運行 - 神經符號整合(Neuro-Symbolic):結合統計學習和邏輯推理 - 神經形態運算(Neuromorphic):仿生物神經元的低功耗 AI 晶片

🎙️ Podcast(中文)

一句話搞懂

深度學習就像一個過目不忘的記憶天才——給它看過百萬個案例,它能找出任何人類難以察覺的模式;但它沒有辦法像人類一樣「思考」因果關係、用三個例子舉一反三、或者解釋「為什麼我這樣判斷」。知道它擅長什麼、不擅長什麼,才能在正確的地方用對工具。

白話解說

局限一:資料饑渴——沒有大量資料就餓死

深度學習的學習方式是從大量資料中歸納統計規律。這種學習方式的前提假設是:可以從足夠多的範例中提取出有意義的模式。

為什麼深度學習特別「渴」資料?

傳統的線性回歸(10 個特徵)可能只需要幾百筆資料就能訓練;決策樹(100 個特徵)可能需要幾千筆。但一個從頭訓練的 ResNet-50(25 百萬參數)需要 ImageNet 的 120 萬張標注圖片才能訓練出競爭力。

這個差距源於參數量:每個參數的估計都需要足夠多的資料來支撐。參數量越多,需要的資料量越大。大型語言模型有數十億到數兆參數,需要的訓練資料量是人類有史以來的所有文字的數倍。

資料稀缺在現實世界的分布:

「大數據」的幻覺 vs 現實:

某些領域確實有大量資料:

✓ 網路文字(Wikipedia、新聞、書籍):數兆 tokens

✓ 通用圖片(網路圖片):數十億張

✓ 電商交易紀錄(Amazon、PChome):數億筆/年

但大多數專業領域資料量嚴重不足:

✗ 台灣罕見疾病 X 光影像:幾百到幾千張

✗ 半導體製程異常圖片:每種瑕疵類型可能只有幾十張

✗ 判決書(繁體中文,特定罪名):幾千份

✗ 特定工廠設備的感測器異常紀錄:幾百筆(異常本來就少)

小數據場景下的替代方案:

| 資料量 | 推薦方法 | 理由 |

|---|---|---|

| < 100 筆標注 | 規則引擎 / 專家系統 | 太少資料,機器學習無法可靠學習 |

| 100–1,000 筆 | 傳統 ML(SVM、Random Forest、XGBoost) | 需要人工特徵工程,但可在小數據上有效 |

| 1,000–10,000 筆 | 遷移學習(預訓練 + 微調) | 借用預訓練知識,彌補標注資料的不足 |

| 10,000–100,000 筆 | 深度學習(標準微調或部分從頭訓練) | 開始可以有效利用 DL 的強大表達能力 |

| > 100,000 筆 | 深度學習(可考慮從頭訓練) | DL 的優勢在此規模才充分發揮 |

局限二:計算資源昂貴——電費和碳排放是真實問題

深度學習不只是算法問題,更是能源消耗問題。

大型模型訓練的碳排放估算:

GPT-3 訓練(OpenAI,2020 年):

計算量:~3.14 × 10^23 FLOP

估計碳排放:552 噸 CO₂

等效:120 輛汽油車行駛一年的排放量

LLaMA 65B(Meta,2023 年):

訓練資料:1.4 兆 tokens

GPU 時間:2,048 A100 GPU × 21 天

估計用電:約 350 MWh(35 萬度電)

GPT-4 訓練(估計,未公開):

成本估算:約 1 億美元

碳排放:估計數千噸 CO₂

推論的隱性成本:

訓練雖然昂貴,但更大的能源消耗其實來自持續不斷的推論服務:

每一次 ChatGPT 對話的推論成本:

用電估算:約 0.001–0.01 kWh(視對話長度)

成本估算:約 0.01–0.04 美元/次(OpenAI 的推論成本估計)

ChatGPT 日活躍用戶:約 1 億(2024 年)

每日全球用電估算:數百 MWh

比較:一次 Google 搜尋約 0.3 Wh,

一次 ChatGPT 對話估計約 3–10 Wh

→ 每次 AI 對話消耗的電力約是 Google 搜尋的 10–33 倍

這個成本問題推動了「高效 AI(Efficient AI)」研究的興起,包括模型蒸餾、量化、稀疏化等技術(詳見未來趨勢章節)。

局限三:黑盒問題——它只告訴你答案,不告訴你為什麼

深度學習模型由數百萬到數十億個參數組成的非線性計算構成,其內部決策過程對人類幾乎是完全不透明的。這就是所謂的黑盒問題(Black Box Problem)。

黑盒問題在哪裡真正會造成危害:

場景一:金融貸款審核

黑盒模型告訴你:「這位申請人的貸款申請被拒絕。」

但你無法得知:為什麼被拒絕?是因為信用評分?還是因為模型

誤解了某個不相關的特徵(如郵遞區號)?是否有歧視(性別/年齡/族裔)?

台灣《金融消費者保護法》和歐盟《一般資料保護規範(GDPR)》

都要求金融機構能夠「解釋」自動化決策。

黑盒 DL 模型在監管上存在合規風險。

場景二:醫療輔助診斷

黑盒模型說:「這張 X 光片顯示 87% 機率有肺結節。」

但醫生無法判斷:模型是真的看到了結節的影像特徵,

還是因為這張影像的拍攝角度、光照、機器型號不同而被誤導?

若模型判斷錯了,醫生無法知道問題出在哪裡,

也無法告知病患「為什麼」做出這個診斷。

場景三:法院判決輔助

如果 AI 根據犯罪紀錄預測再犯率,用於法官的量刑參考,

但模型是黑盒,無法解釋為什麼某個人被預測為「高風險」,

這涉及嚴重的程序正義問題。

常見的可解釋 AI(XAI,Explainable AI)技術:

- LIME(Local Interpretable Model-Agnostic Explanations):在每個輸入樣本附近,用一個簡單的線性模型(可解釋)近似複雜黑盒模型的局部行為

- SHAP(SHapley Additive exPlanations):基於賽局論,計算每個特徵對預測結果的貢獻度(可正可負)

- Grad-CAM(Gradient-weighted Class Activation Mapping):視覺化 CNN 在做分類時,圖像的哪些區域對最終預測貢獻最大(生成「熱力圖」)

這些技術提供了「事後解釋(Post-hoc Explanation)」,但它們只是近似,不是真正揭露了模型的決策過程。在高風險場景,應考慮使用本質上可解釋的模型(如決策樹、邏輯回歸、規則清單)。

局限四:脆弱性——換個場景就不靈

深度學習模型在訓練資料的分布範圍內表現優秀,但一旦遇到分布外(Out-of-Distribution)的資料,效能可能急速崩潰。這就是所謂的分布偏移問題(Distribution Shift)和脆弱性(Brittleness)。

分布偏移的典型例子:

醫療影像跨院遷移問題(現實中非常常見):

醫院 A 用 Siemens CT 機訓練瘤偵測模型:

驗證集準確率:92%(在 Siemens CT 影像上)

部署到醫院 B(使用 GE CT 機):

實際準確率:73%(下降 19 個百分點)

原因:不同品牌的 CT 機在影像的灰階值範圍、噪點特性、

掃描層厚度等方面有差異,這些差異讓預訓練模型面對

「新分布」的影像時大幅退化。

對抗性攻擊(Adversarial Attack)——脆弱性的極端展示:

對抗性攻擊是對輸入做微小、人類幾乎察覺不到的改動,卻讓深度學習模型完全出錯的技術:

圖像分類的對抗性攻擊:

原始圖片:一隻熊貓

→ 模型預測:熊貓(99.3% 信心)

添加一層人眼幾乎看不出的「雜訊」(對抗性擾動):

→ 圖片看起來和原來幾乎一樣(人類仍認為是熊貓)

→ 模型預測:長臂猿(99.9% 信心)

這個現象在自動駕駛安全中引發嚴重擔憂:

一張貼了特製貼紙的停止標誌:

→ 人類司機:正常識別為「停止」

→ 自動駕駛 AI:可能辨識為「時速限制 45 公里」

為什麼深度學習是脆弱的?

深度學習學習的是訓練資料中的「統計捷徑(Shortcut Learning)」,而非人類理解的「本質特徵」。例如:牛的分類模型可能學到「草地背景 → 牛」這個捷徑(因為訓練資料中的牛大多在草地上),導致在其他背景下的牛被分類錯誤,而在草地上的其他動物被誤認為牛。

局限五:缺乏因果推理——相關性不等於因果性

這是深度學習最根本的局限之一。深度學習學習的是統計相關性,而非人類理解世界的方式——因果關係。

相關性 vs 因果性的經典例子:

觀察到的統計相關:

每個夏天,冰淇淋銷量 ↑ 的同時,溺水事故 ↑

→ 統計模型:冰淇淋銷量 和 溺水事故 高度相關

深度學習可能學到的「規律」:

「冰淇淋銷量增加」→ 預測「溺水風險增加」

→ 業務決策:減少冰淇淋銷售可以降低溺水事故?(錯誤!)

真正的因果結構:

夏天高溫 → 游泳活動增加 → 溺水事故增加

夏天高溫 → 外出人數增加 → 冰淇淋銷量增加

「夏天」是共同原因(Confounding Variable),冰淇淋和溺水是被共同原因影響的兩個結果

因果推理缺失的實際危害:

醫療案例:AI 預測敗血症死亡率

資料觀察:使用呼吸機(Ventilator)的病患,死亡率反而低於

未使用呼吸機的類似病患。

深度學習模型可能學到的「規律」:

呼吸機使用 → 較低死亡率 → 建議更多人使用呼吸機

真正的因果結構:

病情輕微的病患 → 不需要呼吸機 → 較低死亡率

病情嚴重的病患 → 需要呼吸機 → 即使使用了,死亡率還是較高

呼吸機和死亡率的相關性是被「病情嚴重程度」這個混淆變數造成的

如果依照 DL 模型的建議,給不需要呼吸機的輕症患者也插管,

不只浪費資源,還可能造成醫源性傷害。

深度學習的因果盲點是工程問題還是根本限制?

這是 AI 研究者辯論的熱門議題。圖靈獎得主 Yoshua Bengio 和因果推理大師 Judea Pearl 都認為:現有的深度學習缺乏建構因果模型的能力,是其達到「人類等級推理」的根本障礙。解決方案之一是將深度學習和因果推理框架(如 Pearl 的 do-calculus)整合,形成神經符號系統(Neuro-Symbolic AI)。

未來趨勢:深度學習的下一步在哪裡

趨勢一:基礎模型(Foundation Models)

「基礎模型」這個詞由 Stanford HAI 研究所在 2021 年提出,指的是在海量通用資料上訓練的超大型模型,它可以被適應(通過微調、提示工程、RAG 等方式)到各種下游任務。

基礎模型改變了 AI 開發方式的本質:

過去:每個任務訓練一個模型

文字分類模型 ← 從頭訓練

物件偵測模型 ← 從頭訓練

語音辨識模型 ← 從頭訓練

翻譯模型 ← 從頭訓練

基礎模型時代:一個模型適應所有任務

GPT-4 / Claude 3 / Gemini

↓ 微調 / 提示工程 / RAG

文字分類 ✓ 物件偵測 ✓ 翻譯 ✓ 代碼生成 ✓ 醫療問答 ✓

基礎模型的能力隨規模展現「湧現(Emergence)」——模型超過某個參數量閾值後,突然能做到在訓練時未曾明確學習的任務(如多步數學推理、類比推理),這種湧現能力仍是 AI 研究的未解之謎。

趨勢二:多模態 AI(Multimodal AI)

早期的 AI 模型各自為政:語言模型只處理文字,視覺模型只處理圖像,語音模型只處理音訊。多模態 AI 打破了這個隔閡,讓單一模型能同時理解和生成多種形式的資料。

多模態 AI 的進展時間線:

2021 年:DALL-E(OpenAI)—— 文字描述 → 圖片生成

2022 年:Stable Diffusion —— 開源文字 → 圖片

2023 年:GPT-4V —— 圖片 + 文字輸入 → 文字輸出(能「看圖說話」)

2024 年:Sora(OpenAI)—— 文字 → 影片生成

Gemini 1.5 —— 文字/圖片/音訊/影片的統一理解

2025 年:Gemini 2.5 / Claude Opus 4 —— 接近原生多模態理解

台灣的多模態 AI 應用機會:

- 製造業:結合設備感測器資料(時序)+ 視覺影像(視覺)+ 維修日誌(文字)的多模態異常偵測

- 醫療:病患病歷(文字)+ 影像(X 光/CT)+ 基因資料(數值)的整合診斷輔助

- 教育:學習資料(文字/影片)+ 學習行為數據(時序)的個人化學習路徑推薦

趨勢三:高效 AI(Efficient AI)

隨著 AI 模型越來越大,「讓大模型在小裝置上高效運行」成為關鍵工程挑戰。

主要技術方向:

模型蒸餾(Knowledge Distillation):用大型「教師模型」的輸出訓練小型「學生模型」,讓學生模型學習教師的知識(而非只看硬標籤),通常學生模型能達到教師 80–90% 的效能,但只有 1/10 的參數量。

蒸餾典型案例:

教師模型:BERT-large(3.3 億參數)

學生模型:DistilBERT(6,600 萬參數,約 1/5)

效能保留:在 GLUE benchmark 上保留 97% 的效能

推論速度:比 BERT-large 快 60%

模型大小:縮小 40%

量化(Quantization):把模型參數從高精度(FP32,32 bits/參數)壓縮到低精度(INT8、INT4,甚至 1-2 bits),大幅減少記憶體和計算需求。

量化的效益(以 LLaMA-3-8B 為例):

FP32(原始):32 GB VRAM

FP16(半精度):16 GB VRAM(效能幾乎不變)

INT8(8-bit 量化):8 GB VRAM(效能損失 < 2%)

INT4(4-bit 量化,如 GGUF Q4_K_M):4 GB VRAM(效能損失 < 5%)

→ INT4 量化的 8B 模型可以在一般筆電(16 GB 記憶體,無 GPU)上流暢執行

稀疏化(Sparsification/Pruning):移除對模型效能貢獻最小的連接(權重設為 0),讓模型變得「稀疏」,減少計算量。

趨勢四:神經符號整合(Neuro-Symbolic AI)

結合深度學習的統計學習能力和符號 AI(Symbol AI)的邏輯推理能力,試圖兼得兩者的優點:

- 深度學習:感知(看圖識字、語音辨識)+ 從大量資料歸納統計規律

- 符號 AI / 邏輯推理:演繹推理(從規則到結論)+ 可解釋性 + 資料高效(Few-shot)+ 確保邏輯一致性

台灣的應用方向:製造業的品質管控(深度學習識別瑕疵 + 符號規則決定報廢/返修邏輯);醫療診斷輔助(深度學習從影像識別候選病灶 + 醫學知識圖譜做鑑別診斷)。

趨勢五:神經形態運算(Neuromorphic Computing)

神經形態晶片模仿生物大腦神經元的「脈衝(Spike)」通訊方式,而非傳統的連續數值矩陣乘法:

傳統 GPU/TPU:

矩陣乘法(密集計算)

功耗:數十到數百瓦

適合:大型模型訓練和推論

神經形態晶片(如 Intel Loihi、IBM TrueNorth):

脈衝神經網路(Spiking Neural Network,SNN)

神經元只在「有訊號時」才消耗電力(事件驅動)

功耗:毫瓦到微瓦等級

適合:低功耗邊緣 AI、IoT 感測器、穿戴裝置

現狀:精度仍落後傳統 DL,是研究中的長期方向

台灣的硬體機會:神經形態晶片的設計和製造正好是台灣半導體產業(台積電、聯發科)可以深度參與的領域,是台灣 AI 硬體發展的長期潛力方向。

應用場景

什麼時候不應該用深度學習

以下是幾個台灣企業的真實場景,說明「不用深度學習」反而是更聰明的選擇:

案例一:中小企業的銷售預測(資料量不足場景)

一家台灣中部的傳統製造廠,月銷售約 200 款產品,希望預測下個月的銷售量來優化備料。他們只有 3 年的月銷售資料,每款產品 36 個月的紀錄。

嘗試深度學習(LSTM):

訓練資料:36 筆 × 200 款 = 7,200 筆(每款 36 個時間點)

結果:模型嚴重過擬合,驗證集 MAPE(平均絕對百分比誤差)= 38%

問題:資料太少,時間序列太短,深度學習沒有優勢

改用傳統統計方法(SARIMA / Prophet):

MAPE = 14%(遠優於 LSTM)

理由:統計時序模型明確建模季節性、趨勢、節日效應,

不需要大量資料就能捕捉這些可解釋的規律

結論:在此場景,傳統統計方法 >> 深度學習

案例二:銀行信貸風險評估(可解釋性需求場景)

台灣某區域銀行想為中小企業貸款申請建立風險評分模型。

嘗試深度學習(多層 MLP):

AUC-ROC:0.89(優秀的區別能力)

問題:

1. 金融監理機關(金管會)要求銀行能解釋「為什麼拒絕某申請」

2. 《消費者保護法》保障申請人有知道理由的權利

3. 模型是否對特定地區或產業有隱性歧視,無法驗證

改用 XGBoost + SHAP 解釋:

AUC-ROC:0.87(略低,但仍優秀)

優點:

✓ SHAP 圖可以解釋每個申請被評為高風險的具體原因

✓ 可以生成「給申請人的拒貸說明」(「您的負債比率超過業界均值 1.4 倍」)

✓ 可以檢查是否有對特定族群的歧視性模式

結論:在高監管要求場景,「稍差但可解釋的模型」> 「更準但不可解釋的模型」

案例三:生產線即時品質管控(低延遲 + 確定性需求場景)

一家半導體封裝廠,需要在 5 毫秒內判斷晶片的 5 個電性參數是否符合規格,不符合就觸發報警。

深度學習方案:

雖然可以訓練一個能預測不良品的 MLP

但問題:

- 規格是精確的數值範圍(± 5%),不是模糊的特徵

- 規格可以隨產品批次精確調整

- 需要 100% 可解釋(為什麼這顆晶片是不良品)

- 5ms 延遲要求在某些情況下 DL 推論也難以穩定達到

規則引擎(直接的 if-then 條件判斷):

if (voltage < 2.97 or voltage > 3.03): # ±1% 電壓容差

flag_as_defective("電壓超標")

elif (current > 15.2e-3): # 電流上限

flag_as_defective("電流過大")

...

✓ 延遲:< 0.1ms

✓ 100% 可解釋(直接輸出超出規格的參數名稱和實際值)

✓ 規格變更時,工程師直接修改數字,不需要重新訓練模型

✓ 完全確定性(相同輸入保證相同輸出)

結論:規格明確、延遲嚴苛、需要解釋的場景,規則引擎 >> 深度學習

常見誤區

誤區一:深度學習效果越來越好,最終會取代所有傳統機器學習方法

這個觀點把「在大型基準測試上的表現」等同於「在所有實際場景中的適用性」。深度學習確實在 ImageNet 圖像分類、語言模型基準等大規模任務上遠超傳統方法;但在表格資料(Tabular Data)上,XGBoost 和 LightGBM 至今仍是很多 Kaggle 競賽和業界應用的首選——即使有 TabNet、FT-Transformer 等針對表格資料的深度學習方法,在中小型資料集上的優勢仍不穩定。每種工具有其最適合的場景,「最新的深度學習一定最好」是工具崇拜,不是工程思維。在決定使用哪個方法之前,先評估你的資料量、特徵類型、延遲要求、可解釋性需求,再做選擇。

誤區二:深度學習模型在驗證集上表現好,部署後效果也會一樣好

驗證集的表現只能保證模型在「和訓練資料來自同一分布」的資料上表現良好。一旦部署到生產環境,面對真實世界的資料,各種「分布偏移」就可能發生:用戶行為隨時間改變(Concept Drift)、資料收集環境改變(如感測器老化、攝影機角度調整)、出現訓練時從未見過的新情況。這就是為什麼「部署後監控(Production Monitoring)」和「模型再訓練(Retraining)機制」是 MLOps 的核心。忽視分布偏移,把在驗證集上的高準確率當作部署後效果的保證,是許多 AI 專案失敗的根本原因。

誤區三:大型語言模型(LLM)已經可以進行真正的推理,深度學習的因果推理局限已經被克服

GPT-4、Claude 等 LLM 在推理任務(如 GSM8K 數學題、邏輯題)上表現令人驚艷,讓很多人以為 LLM 已經能「真正推理」。但研究顯示,LLM 在這些任務上的成功,很大程度上是訓練資料中見過類似問題的記憶和模式匹配,而非真正建構了因果模型。當問題被稍微改寫(如改換數字、調整條件)或超出訓練資料的覆蓋範圍,LLM 的「推理能力」往往顯著下降,還會自信地給出錯誤答案(幻覺,Hallucination)。LLM 是強大的語言模式識別和泛化工具,但「語言層面的推理」和「真正的因果推理」之間仍有根本差距,是目前 AI 研究的核心課題。

小練習

練習一:選擇合適的工具

你是一家台灣保險公司的 AI 主管,以下是四個來自不同業務部門的 AI 需求,請為每個需求選擇最合適的技術方案,並說明理由(選項包括:深度學習、傳統機器學習、規則引擎、統計方法):

需求 A:理賠詐欺偵測系統。歷史資料:過去 8 年,300 萬件理賠申請,其中已標注詐欺案件 15,000 件(詐欺率約 0.5%)。特徵:申請人資料、申請金額、醫療機構、申請時間間隔等 150 個結構化特徵。需求:模型輸出需要能解釋「為什麼這件申請被標記為疑似詐欺」,供人工覆查人員參考。

需求 B:醫療費用估算系統。客戶輸入:年齡、性別、過去就醫次數、慢性病類型(5 類)。輸出:未來一年預估醫療費用的分布(中位數和 80% 信賴區間)。資料:10 萬名客戶的 5 年歷史理賠紀錄。

需求 C:核保決策輔助系統。客戶提交健康檢查報告(PDF 中的 20 個數值指標,如血壓、血糖、BMI 等)。系統需要根據公司核保手冊的規則,自動計算「標準體」、「次標準體(加費)」、「拒保」的建議,並列出觸發的具體規則。核保手冊已有明確的數值範圍規定。

需求 D:客服語音轉文字與情緒分析系統。每日處理 10,000 通客服電話,轉成文字後分析客戶情緒(正面/負面/中性)和主要訴求類別(理賠進度/保費問題/保單查詢等)。

看解答

**需求 A:詐欺偵測 → 傳統機器學習(XGBoost + SHAP)** 選擇理由: - 資料充足(300 萬筆、150 個特徵)且為結構化表格資料,這是 XGBoost 的最強場景 - 詐欺偵測在表格資料上,XGBoost 歷來在實際案例中表現不亞於甚至優於深度學習 - **可解釋性是核心需求**:SHAP 值可以為每個可疑案件生成特徵重要性報告(「此案件被標記的主要原因:申請金額是同類型理賠的 3.2 倍標準差、同一醫療機構在 30 天內有 8 筆高額申請」),直接提供給人工覆查員 - 深度學習(如 Transformer)在此場景不是最佳選擇:精度提升有限,但喪失了可解釋性,且 0.5% 的極度類別不平衡對訓練和閾值選擇需要特別處理,XGBoost 有更成熟的實作(scale_pos_weight 等) 補充注意:此場景需要特別處理類別不平衡(詐欺 0.5%),建議使用 SMOTE 過採樣或直接用 AUC-PR(精確率-召回率曲線下面積)而非 AUC-ROC 作為評估指標,後者在不平衡資料上更有意義。 **需求 B:醫療費用估算 → 統計方法(廣義加性模型 GAM,或 XGBoost 回歸)** 選擇理由: - 核心需求是「分布估算」(中位數 + 信賴區間),不只是點預測 - 特徵只有幾個(年齡、性別、就醫次數、慢性病類型),資料雖有 10 萬筆,但特徵維度低,深度學習無顯著優勢 - **廣義加性模型(GAM)**(如 Python 的 pygam 套件):每個特徵的影響可以被視覺化為平滑曲線(「年齡和醫療費用的非線性關係」),可解釋性高,且自然支援信賴區間估計 - 若需要更準確的點預測且可接受降低可解釋性,XGBoost 回歸 + conformal prediction(無分布假設的信賴區間方法)也是好選擇 - 不建議深度學習:特徵數量少(維度詛咒反向)、資料量對 DL 來說偏少、不需要圖像或文字的複雜特徵提取 **需求 C:核保決策輔助 → 規則引擎(直接實作核保手冊的邏輯)** 選擇理由: - **規則已明確存在**(核保手冊),不需要從資料中「學習」規則——這正是規則引擎最適合的場景 - 絕對需要可解釋性和確定性:核保決策是法規遵循的高風險決策,必須能精確說明「因為血壓收縮壓 = 145 mmHg,超過標準體上限 140 mmHg,觸發次標準體規則 A-12,加費 20%」 - 規則變更時(如核保手冊更新),只需修改規則代碼,不需要重新訓練模型 - 用機器學習來「學習」已經有明確規則的邏輯,是工程上的過度設計,也引入了不必要的黑盒風險 實作建議:使用業務規則引擎框架(如 Python 的 business-rules 套件,或商業的 Drools)管理規則,而非硬編碼,方便核保人員在不寫代碼的情況下維護規則。 **需求 D:語音轉文字 + 情緒分析 → 深度學習(Whisper + BERT 微調)** 選擇理由: - 語音轉文字(STT)本質上是複雜的序列建模任務,需要理解聲學特徵和語言模型,深度學習(如 OpenAI Whisper)是此任務的最先進解決方案,無替代品 - 情緒分析和意圖分類是 NLP 任務,有大量可用的預訓練模型(BERT 系列),遷移學習效率極高 - 資料規模(10,000 通/日)足夠進行監督微調,且可持續收集標注資料改善模型 - 不需要個案級別的解釋(整體趨勢分析為主),可解釋性要求較低 技術方案: ``` 語音 → Whisper-large-v3(繁體中文 ASR,現成可用)→ 文字 文字 → bert-base-chinese 微調 分類頭 1:情緒(正/負/中,3 類) 分類頭 2:訴求類別(理賠/保費/保單/其他,4 類) → 同時輸出情緒和訴求標籤 整合:每日自動統計各類情緒和訴求的分布,生成報表供客服主管參考 ``` 若預算有限,情緒分析甚至可以使用 ChatGPT API(提示工程,零樣本分類),免去微調的工程成本,但需評估資料隱私(客服錄音是否可以傳送外部 API)。練習二:評估 AI 方案的局限性

台灣某醫療集團計劃引入一套 AI 系統,用於輔助基層診所的「糖尿病眼部病變早期篩查」。以下是系統廠商的提案說明:

本系統使用在 US FDA 已核准、於美國 20 萬張糖尿病視網膜病變影像上訓練的 AI 模型,準確率(AUC-ROC)達 0.97,靈敏度 87.2%,特異度 90.3%。部署後,基層診所的護士使用眼底攝影機拍攝照片後上傳系統,AI 在 30 秒內給出「正常 / 輕度病變 / 中重度病變(建議立即轉診)」的判斷。

你的任務是評估這套系統的潛在局限和風險:

- 廠商說「在 20 萬張美國資料上訓練,AUC 0.97」,這對台灣診所的部署有哪些隱患?

- 「護士使用眼底攝影機」這個部署場景可能引發哪些分布偏移問題?

- 如果你是這家醫療集團的 AI 主管,你會要求廠商在簽約前提供哪些額外的驗證報告?