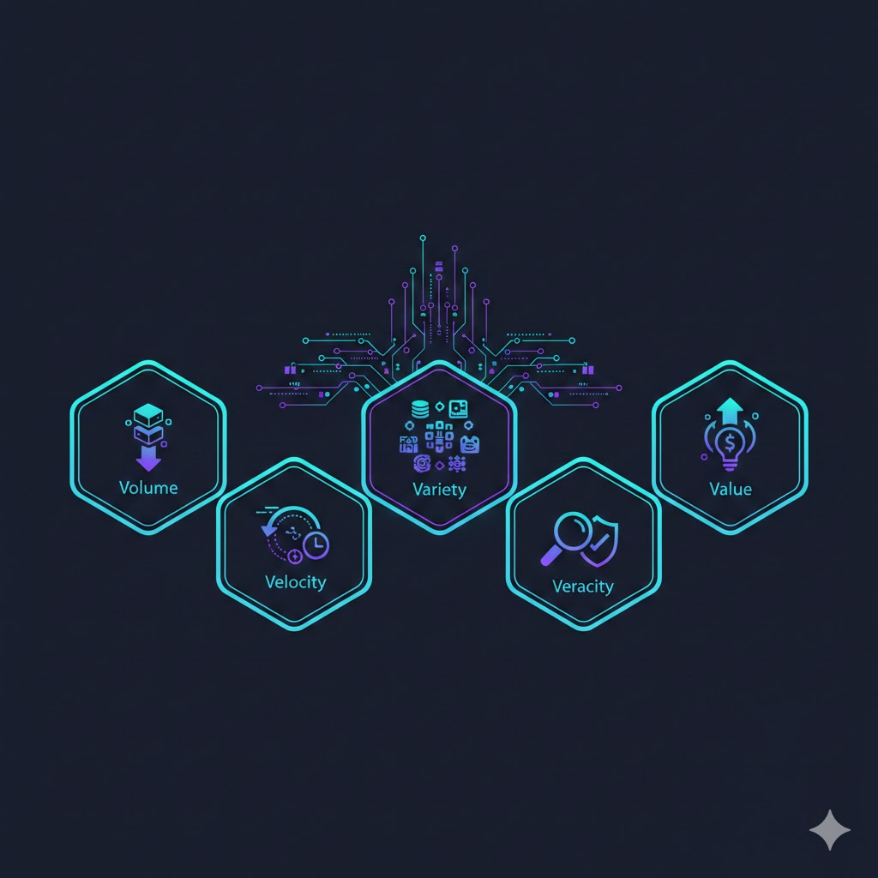

M08.01|大數據的 5V:Volume、Velocity、Variety、Veracity、Value

資料大不等於大數據 — 要同時具備五個 V 才算數

本講學習重點

Volume(量):資料規模超過單機處理能力,通常以 TB/PB 計量,需要分散式儲存(HDFS、物件儲存)

Velocity(速度):資料產生和處理的速度,分批次處理(Hadoop MapReduce)和串流處理(Kafka + Spark Streaming)

Variety(多樣性):結構化(關聯式資料庫)、半結構化(JSON/XML/Log)、非結構化(圖片/影片/文字)

Veracity(真實性):資料的準確度、完整性、一致性,髒資料導致「垃圾進垃圾出(GIGO)」

Value(價值):從海量資料中萃取有意義的洞見,是大數據的終極目標;資料量大不代表價值高

5V 並非全部同等重要:Veracity 和 Value 是最常被忽略但最影響 AI 系統品質的兩個維度

不是所有資料都要用大數據技術:規模、複雜度、即時性需求都要考量

🎙️ Podcast(中文)

一句話搞懂

大數據不是「資料很多」那麼簡單——它是同時具備 Volume(海量)、Velocity(高速)、Variety(多元)、Veracity(可信)、Value(有價值)五個維度的資料挑戰,缺少任何一個 V,都不能真正稱作「大數據問題」,更談不上從中萃取 AI 所需的高品質訓練素材。

白話解說

從一個超市收銀機說起

假設一家有五十間分店的連鎖超市,每天每間店平均處理三千筆交易,一年下來累積超過五千萬筆消費紀錄。這樣算大數據嗎?從 Volume 的角度看,五千萬筆紀錄在現代硬碟上只不過是幾十 GB,一台普通的桌上型電腦就能存得下、查得動。所以單純用「資料很多」來定義大數據,其實是一個很常見的誤解。

真正的大數據問題通常出現在:資料規模讓單台機器的記憶體或磁碟無法容納(需要分散式儲存)、資料產生的速度快到來不及一筆一筆慢慢處理(需要串流架構)、資料的格式五花八門無法塞進同一張資料庫表格(需要彈性的儲存方案)、資料的來源品質參差不齊不能直接信任(需要資料清洗和驗證流程)、以及最關鍵的——就算前四個都解決了,如果最終分析結果沒有帶來任何可行動的商業洞見,那一切努力都是浪費。五個 V 共同構成了大數據問題的完整輪廓。

Volume:量到讓單機撐不住

Volume(資料量)是大數據最直觀的特性,通常以 TB(Terabyte,1TB = 1,024GB)、PB(Petabyte,1PB = 1,024TB)甚至 EB(Exabyte)為計量單位。Facebook 每天產生超過 4 PB 的資料,人類基因組計畫的全球測序資料總量以 EB 計。量大的核心挑戰是:單台機器的儲存和計算能力有天花板,必須拆分成多台機器協同工作。

處理大量資料的主流架構是分散式計算:Google 2004 年發表的 MapReduce 論文奠定了理論基礎,開源的 Hadoop 生態系(HDFS 分散式檔案系統 + MapReduce 計算框架)讓大規模分散式處理從實驗室走進企業。後來 Apache Spark 以記憶體內運算(In-Memory Computing)取代 MapReduce 的硬碟讀寫,把批次處理速度提升了 10–100 倍。現代企業常見的方案是把資料存在雲端物件儲存(AWS S3、Google Cloud Storage、Azure Blob),按需呼叫 Spark 或 Presto 進行查詢和分析,不再需要自己維護實體的 Hadoop 叢集。

Velocity:快到來不及等

Velocity(速度)指資料產生的速率,以及系統必須在多短的時間內完成處理和回應。速度需求從「次日報告」到「毫秒級即時回饋」不等,不同業務場景對速度的要求差異巨大。

傳統的批次處理(Batch Processing)模式是:每天晚上把當天的交易資料匯集起來,跑一個幾小時的 Hadoop 作業,隔天早上管理層看到昨天的報表。這對每日銷售分析夠用,但對股票交易系統(毫秒級決策)、信用卡詐欺偵測(必須在交易完成前幾秒內判斷)、或外送平台的即時動態定價(每分鐘都在變化),批次處理完全跟不上。串流處理(Stream Processing)架構因此誕生:資料一產生就立刻進入處理管線,Apache Kafka 負責接收和緩衝高速資料流,Apache Spark Streaming 或 Apache Flink 負責即時計算。Velocity 的高需求通常意味著更複雜的架構和更高的成本,設計系統時必須先問清楚:這個業務場景真的需要秒級即時嗎?還是五分鐘延遲就夠了?

Variety:格式五花八門

Variety(多樣性)描述的是資料格式的異質性。傳統的資料庫系統設計之初,預設所有資料都是結構化(Structured)的:有固定欄位、固定資料型別,整整齊齊存在關聯式資料庫的表格裡(訂單 ID、客戶 ID、金額、日期……)。但現實世界的資料遠比這複雜。

半結構化(Semi-structured)資料有一定的格式但不固定:網頁爬蟲抓下來的 HTML、API 回傳的 JSON/XML、伺服器的 Log 檔(格式因服務而異)。非結構化(Unstructured)資料完全沒有預定格式:用戶上傳的圖片、影片、語音,社群媒體上的自由文字評論,電子郵件內文,PDF 報告。目前全球產生的資料中,非結構化資料佔比超過 80%,而傳統關聯式資料庫幾乎無法直接處理這類資料。

應對多樣性的技術方案包括:NoSQL 資料庫(MongoDB 存 JSON 文件、Cassandra 存時間序列、Neo4j 存圖形關係)應對不同格式需求;資料湖(Data Lake)架構把所有格式的原始資料先統一存放,之後再按需取用並做格式轉換(ETL/ELT);多模態 AI 模型(如 GPT-4V、Gemini)能同時處理文字和圖像,是解決多樣性最新的 AI 層面方案。

Veracity 和 Value:最容易被忽略的兩個 V

Veracity(真實性/可信度)是關於資料品質的維度,也是大數據工程師最頭痛的日常。真實世界的資料充滿問題:感測器故障導致的異常值、用戶故意輸入的假資料、資料庫欄位定義不一致(同樣是「銷售金額」,A 系統含稅 B 系統不含稅)、記錄重複、時區混亂、缺漏值。IT 界有一句話流傳已久:「垃圾進,垃圾出(Garbage In, Garbage Out, GIGO)」——一個用低品質資料訓練的 AI 模型,輸出的預測結果同樣不可靠,而且往往比沒有 AI 更危險,因為它會帶著「AI 說的」的光環誤導決策。資料工程師通常把 50–80% 的時間花在資料清洗和品質驗證上,而不是建模分析。

Value(價值)是所有 V 中最終極也最容易被忽視的一個。企業花費龐大資源建立大數據平台,收集和儲存了海量資料,但如果最終產出的分析洞見沒有支持任何決策、沒有改善任何業務指標,這些投資就是沉沒成本。大數據的真正目的不是「有資料」,而是「用資料創造價值」。衡量大數據投資是否成功,應該問:哪些決策因為這些資料而做得更好了?哪些業務指標因此改善了?資料價值的實現,需要資料工程、資料分析、業務領域知識三者的緊密協作。

應用場景

| 場景 | 主要涉及的 V | 核心挑戰 | 代表技術 |

|---|---|---|---|

| 電商即時推薦系統 | Velocity + Value | 用戶每次點擊都要在 100ms 內更新推薦結果 | Kafka + Redis + 實時特徵計算 |

| 社群媒體內容審查 | Volume + Variety | 每分鐘百萬則貼文,含文字、圖片、影片、直播 | 分散式佇列 + 多模態 AI 分類 |

| 工業 IoT 預測維護 | Velocity + Veracity | 感測器故障率高,資料噪音大,但停機成本極高 | 串流處理 + 異常偵測 + 資料清洗管線 |

| 醫療影像 AI 診斷 | Volume + Variety | 高解析度 DICOM 影像,每張數百 MB,需要結合病歷文字 | 分散式儲存 + 多模態深度學習 |

| 金融詐欺即時偵測 | Velocity + Value | 交易完成前 3 秒內必須判斷是否封鎖,誤判代價高 | 串流 ML 推論 + 規則引擎混合 |

| 新聞媒體輿情分析 | Variety + Veracity | 多語言、多平台、真假新聞混雜,需識別可信來源 | NLP + 來源可信度評分 + 圖譜分析 |

| 政府開放資料整合 | Variety + Veracity | 不同部門資料格式不統一,定義不一致(如「戶籍人口」vs「實住人口」) | 資料標準化 + 語意對應(Ontology) |

常見誤區

誤區 1:「資料量越大,AI 模型就越準確」

這是對大數據最普遍的誤解。資料量(Volume)固然重要,但在 AI 模型訓練中,資料品質(Veracity)和資料相關性遠比數量更關鍵。一個只有一萬筆但高品質、標注正確、分佈均勻的訓練集,往往能訓練出比一百萬筆低品質、標注錯誤、分佈偏斜的資料集更好的模型。舉例來說,某銀行想訓練一個詐欺偵測模型,如果訓練資料中正常交易佔 99.9%、詐欺交易只有 0.1%(嚴重類別不平衡),即使有幾百萬筆資料,模型可能學到一個「全部預測為正常交易就有 99.9% 準確率」的無用策略。解決之道不是收集更多資料,而是針對少數類別(詐欺交易)進行過採樣(SMOTE)或改變損失函數的權重,這是 Veracity 和 Value 維度的問題,不是 Volume。

誤區 2:「所有資料都要存下來,以後一定用得到」

「先把資料存著,以後說不定有用」這個想法在雲端儲存費用低廉的時代很普遍,但它帶來的問題比解決的多。首先是成本問題:資料儲存不是免費的,PB 級別的資料每年的儲存和管理成本可達數百萬美元;其次是隱私合規問題:GDPR(歐盟個人資料保護規範)和台灣個資法都規定,收集個人資料必須有明確的目的,且只能保存必要的期限——無目的地囤積個人資料是法規違規;第三是資料治理難題:無差別存放的資料湖很容易變成「資料沼澤(Data Swamp)」——有大量資料但沒有人知道有什麼、在哪裡、是否還有效、是否可以使用。正確做法是在資料收集前先定義清楚目的(Value)、保存期限、和存取權限,這才是成熟的資料治理。

誤區 3:「有了大數據平台,就能自動得到洞見」

大數據平台(Hadoop 叢集、資料湖、Spark 叢集)只是資料的儲存和運算基礎設施,它本身不會自動分析資料、不會自動提出問題、也不會自動把數字變成決策。就像買了一個超大的廚房和一堆食材,並不會自動變出一桌好菜——你還需要廚師(資料分析師)、食譜(分析框架和業務問題定義)、以及用餐者的口味偏好(決策者對洞見的需求)。很多企業花了大錢建大數據平台,最後束之高閣,原因正是忽略了 Value 的問題:沒有明確定義「我們想從這些資料中回答什麼問題?」就貿然投資技術基礎設施,是大數據失敗案例最常見的根因。

小練習

練習 1:辨識 5V 的主要挑戰

以下三個真實場景,請分別指出最主要的一到兩個 V 挑戰,並說明理由。

場景 A:一家全台有 300 間門市的便利商店,想分析過去十年所有門市每天每小時的銷售資料,找出不同天氣條件下各類商品的銷售規律。

場景 B:某社群平台要在用戶發出有害言論的 5 秒內自動封鎖,每秒全球用戶產生 50,000 則貼文,包含中英日韓多種語言和表情包圖片。

場景 C:一家醫院要整合 20 年的病歷資料,問題是早期病歷是紙本掃描 PDF,中期是 Word 文件,近期才有結構化的電子病歷系統(HIS),且不同醫師對同一疾病有不同的診斷代碼習慣。

查看答案

**場景 A:便利商店十年銷售分析** 主要挑戰:**Volume** 300 間門市 × 每天 24 小時 × 10 年 = 超過 2,600 萬筆小時級資料(若細到每筆交易則以億計)。這個規模超出傳統關聯式資料庫的高效查詢範圍,需要分散式儲存和分散式查詢引擎(如 Spark SQL 或 Presto)。速度需求不高(這是歷史回顧分析,批次處理即可),格式也相對統一(交易資料是結構化的),所以 Velocity 和 Variety 不是主要挑戰。 次要挑戰:**Veracity** — 十年間可能有門市系統升級、資料格式變更、收銀機故障記錄的異常值,需要跨時間段的資料一致性驗證。 **場景 B:社群平台有害言論即時偵測** 主要挑戰:**Velocity + Variety** Velocity:5 秒內必須完成判斷,這是嚴格的即時性需求,批次處理完全不可行,必須使用串流處理架構(Kafka + 低延遲推論服務)。 Variety:多語言文字(中英日韓)加上圖片(表情包可能包含隱性仇恨符號),文字和圖片必須各自或聯合分析,屬於多模態多樣性挑戰。 Volume 在這裡是背景條件(每秒 50,000 則確實量大),但核心限制是速度和多樣性。 **場景 C:醫院 20 年病歷整合** 主要挑戰:**Variety + Veracity** Variety:三種格式(PDF 掃描圖片 → 需要 OCR、Word 文件 → 需要文字擷取和解析、結構化 HIS → 可直接查詢),同一資料以完全不同的形式存在,無法直接放入同一張表格。 Veracity:不同醫師對同一疾病用不同診斷代碼(如 ICD-9 vs ICD-10 的版本差異,加上個人編碼習慣),同一欄位在不同系統中含義不同,資料完整性問題嚴重。這是最影響後續 AI 模型品質的根本問題。 此場景 Volume 並非主要挑戰(醫院 20 年病歷對現代系統而言規模可控),核心問題是格式整合和品質驗證。練習 2:為新創公司設計大數據策略

一家剛成立的外送平台新創公司,目前日訂單量約 1 萬筆,計劃兩年後達到日訂單量 100 萬筆。他們想收集的資料包括:訂單資料、GPS 位置追蹤(每 5 秒一筆)、用戶評價文字和照片、餐廳菜單(含食材描述)。請回答以下三個問題:

- 目前日訂單量 1 萬筆,是否需要大數據架構?為什麼?

- 哪個 V 的挑戰在這家公司成長過程中會最先爆發?

- 從 Veracity 角度,GPS 位置資料最可能遇到什麼品質問題?如何處理?