M08.09|資料倫理與隱私保護

數據的力量越大,責任越重 — 讓 AI 既聰明又合乎道德

本講學習重點

去識別化 ≠ 匿名化:移除姓名、身分證號後仍可透過組合其他屬性(年齡+郵遞區號+性別)重新識別,Netflix 電影評分、AOL 搜尋紀錄都是真實案例

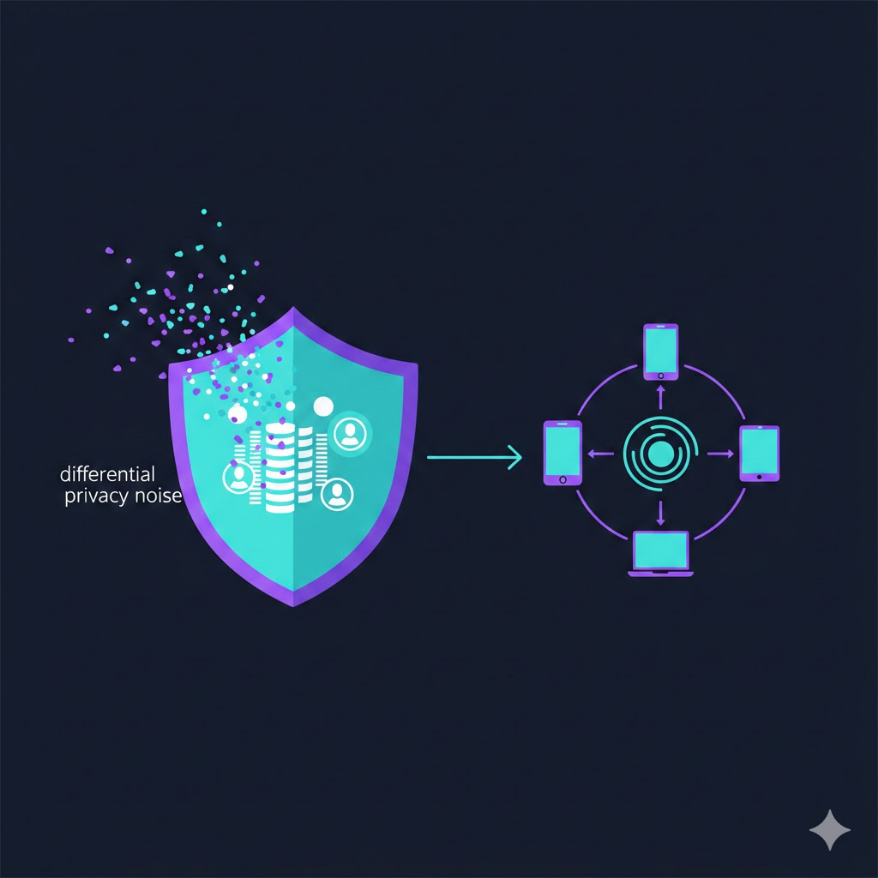

差分隱私(Differential Privacy):在輸出結果(如統計查詢)加入校準的隨機噪音,確保任何單一個體的資料有沒有在資料集中,對輸出結果的影響可以忽略不計,ε 控制隱私預算

聯邦學習:資料不出本地,只上傳模型梯度(更新);解決醫療、金融場景下資料無法集中的問題;缺點是通訊成本高、梯度可能洩漏部分資訊(梯度攻擊)

k-匿名性:每個人的記錄和至少 k-1 個其他人無法區分;l-多樣性:每個等價類中的敏感屬性至少有 l 個不同值

演算法偏見來源:訓練資料的歷史偏見(COMPAS 再犯預測系統對黑人偏高)、特徵選擇、代理特徵(郵遞區號代理種族)

GDPR 核心原則:目的限制、資料最小化、儲存期限、資料主體權利(存取、更正、刪除、可攜)、資料洩漏通報(72 小時)

台灣個資法:特種個資(病歷、性取向等)有更高保護;違反罰鍰可達 2000 萬;需要設置個資保護機制

🎙️ Podcast(中文)

一句話搞懂

資料倫理是一系列確保「AI 系統使用資料的方式不傷害個人和社會」的原則與技術——包括保護個人隱私不被識別(差分隱私、k-匿名性)、讓模型可以在不集中資料的前提下訓練(聯邦學習)、防止 AI 重複甚至放大社會偏見(演算法公平性),以及遵守個資保護法規(GDPR、台灣個資法);在大數據時代,忽視資料倫理不只是道德問題,更是法律風險和商業信任的核心課題。

白話解說

去識別化的神話:為什麼刪掉名字還不夠

2006 年,Netflix 公開了 50 萬用戶的電影評分資料(每筆記錄包含用戶編號、電影名稱、評分、日期),宣稱已完全匿名化處理(用隨機編號替換了用戶姓名)。但幾個月後,德州大學兩位研究員發表論文,展示了一種方法:只需在 IMDB(另一個公開的電影評分網站)中搜尋,比對某個用戶在 Netflix 的評分時間和分數,就能以 84% 的準確率重新識別出具體的 Netflix 用戶真實身分。

這個案例揭示了一個根本性的問題:去識別化(De-identification)≠ 匿名化(Anonymization)。移除直接識別符(姓名、身分證號、電話)後,資料中仍然保留著大量的準識別符(Quasi-identifiers)——年齡、性別、郵遞區號、職業、行為模式等。這些準識別符的組合往往足以唯一識別特定個人。

一個著名的研究顯示:在美國,僅僅用出生年月日 + 性別 + 郵遞區號這三個屬性的組合,就可以唯一識別 87% 的美國人口。在台灣,類似的組合同樣有極高的識別能力。

更進一步,現代的重識別攻擊(Re-identification Attack)可以利用多個資料集的交叉比對來識別個人。一份醫療資料(有年齡、疾病、就診日期)+ 一份公開的戶籍資料,結合後可能足以識別出「這個病患就是 A 先生」。

這意味著,不能把「刪除姓名和身分證」等同於「資料保護完成」。真正的隱私保護需要更嚴格的技術措施。

k-匿名性:讓每個人「混入人群」

k-匿名性(k-Anonymity)是 1998 年提出的隱私保護框架,核心思想非常直觀:讓資料中的每個人,都和至少 k-1 個其他人「看起來一樣」,使得攻擊者無法把你從這 k 個人中區分出來。

具體做法是對準識別符進行概化(Generalization)和抑制(Suppression):

- 把「1990 年 3 月 15 日」概化為「1990 年 3 月」或「1990 年代」

- 把具體郵遞區號「10001」概化為「100XX」(縣市層級)

- 把少數人群(如某郵遞區號內只有 1 個 88 歲的男性)的記錄整個刪除(抑制)

k-匿名性的常見增強版本:

- l-多樣性(l-Diversity):確保每個「等價類」(即所有準識別符相同的人群)中,敏感屬性(如疾病診斷、薪資)至少有 l 個不同的值,防止攻擊者從「同一組人群都有糖尿病」這樣的同質性推斷出你的疾病狀況。

- t-緊密性(t-Closeness):進一步要求等價類中的敏感屬性分佈和整體資料集的分佈保持相近,防止統計推斷。

k-匿名性的限制:概化過多會嚴重降低資料的分析價值(把年齡都概化成「20-70 歲」,這個欄位就幾乎沒有用了);而且 k-匿名性只能抵抗靜態的重識別攻擊,對於結合外部輔助資訊的動態攻擊,保護力有限。

差分隱私:給隱私保護一個數學定義

差分隱私(Differential Privacy, DP)是由 Cynthia Dwork 於 2006 年提出的嚴格數學隱私定義,它解決了 k-匿名性的根本性問題:提供可量化的、強大的隱私保護,同時保留統計資料的分析價值。

核心直覺:無論你的資料有沒有在資料集中,攻擊者從資料集的統計輸出所能得到的關於你的資訊,都幾乎相同。換言之,「你的參與對統計結果的影響小到可以忽略不計」。

數學定義:一個隨機化的機制 M 滿足 ε-差分隱私,如果對任意兩個只差一筆記錄的資料集 D 和 D’,以及任意可能的輸出 S:

P[M(D) ∈ S] ≤ e^ε × P[M(D’) ∈ S]

ε(epsilon)是隱私預算(Privacy Budget):ε 越小,隱私保護越強(輸出結果受個別記錄影響越小),但資料的統計精確度越低(引入的噪音越大);ε 越大,資料更有用,但隱私保護較弱。典型值範圍在 0.1(強隱私)到 10(弱隱私)之間。

最常用的差分隱私機制是加噪音(Noise Addition):

- 拉普拉斯機制(Laplace Mechanism):在數值型查詢結果上加入拉普拉斯分佈的隨機噪音,噪音的規模與 ε 和查詢函數的「敏感性」成比例。例如,查詢「台灣有多少人有糖尿病」時,在真實答案上加一個小的隨機數(如 ±50 人),確保沒有任何人的病歷記錄存在與否能讓這個統計數字改變超過某個可忽略的量。

- 隨機回應(Randomized Response):在收集個別資料時引入隨機性,例如問卷調查中的敏感問題(「你有沒有逃稅?」),每個人以一定機率如實回答、以一定機率給出隨機答案,研究者可以從整體統計結果中扣除掉隨機效應,估計真實比例,但無法確定任何具體個人的答案。

差分隱私的真實應用:Apple 的 iOS 鍵盤功能(收集用戶輸入的常用詞語統計,以改善自動校正)使用本地差分隱私(Local Differential Privacy),在資料離開設備前就加入噪音;Google 的 RAPPOR 使用類似機制收集 Chrome 瀏覽器使用統計;美國人口普查局(Census Bureau) 在 2020 年人口普查中採用差分隱私保護個人資料。

聯邦學習:讓資料不出門也能訓練模型

在醫療、金融、電信等領域,訓練高品質 AI 模型需要大量資料,但這些資料因為法規、商業競爭、技術安全等原因無法集中在同一個地方。聯邦學習(Federated Learning)提供了一種解決方案:讓模型訓練在資料所在的本地節點進行,只上傳模型的更新(梯度),而非原始資料本身。

聯邦學習的基本流程:

- 中央伺服器把當前的全局模型發送給所有參與的節點(如各家醫院、各台用戶手機)。

- 每個節點在本地的資料上訓練模型,計算模型參數的更新量(梯度)。

- 每個節點只上傳梯度(而非原始資料)給中央伺服器。

- 中央伺服器對所有節點的梯度進行聯合聚合(如取平均,即 FedAvg 算法),更新全局模型。

- 重複上述步驟,直到模型收斂。

聯邦學習的優勢:

- 原始資料從不離開本地,符合 GDPR、台灣個資法等法規要求。

- 可以整合跨機構的資料「知識」(如多家醫院的影像資料),訓練更精準的模型,同時保持資料隔離。

- 特別適合移動設備:Google 用聯邦學習改進 Gboard(Android 鍵盤)的下一詞預測,訓練在每台手機本地進行。

聯邦學習的挑戰和限制:

- 梯度洩漏(Gradient Inversion Attack):研究顯示,在某些條件下可以從梯度中反向推算出(部分)原始訓練資料,梯度本身並非完全安全。解決方案包括:差分隱私(在梯度上加噪音)和安全多方計算(Secure Multi-Party Computation)。

- 非 IID 資料(Non-Independent and Identically Distributed):各節點的資料分佈不同(如城市醫院和鄉村醫院的病例分佈差異很大),標準的 FedAvg 聚合效果會降低,需要更複雜的個性化聯邦學習算法(FedProx、SCAFFOLD 等)。

- 通訊成本高:每輪訓練需要和數百個節點通訊,大模型的梯度傳輸量非常大,是聯邦學習的工程瓶頸。

演算法偏見:AI 如何重複和放大歧視

演算法偏見(Algorithmic Bias)是指 AI 系統的輸出對特定群體(如特定種族、性別、年齡、社經地位)系統性地更有利或更不利,從而導致不公平的影響。

最著名的案例是 COMPAS(Correctional Offender Management Profiling for Alternative Sanctions)系統,被美國多個司法管轄區用於預測犯罪嫌疑人的再犯機率,作為假釋和量刑的參考。ProPublica 在 2016 年的調查分析顯示,COMPAS 系統對黑人被告的再犯風險評估系統性地偏高(假陽性率更高),對白人被告則偏低(假陰性率更高)——即使控制了其他相關因素之後,種族偏見仍然顯著存在。

演算法偏見的來源:

訓練資料中的歷史偏見:如果訓練資料反映了社會中已有的系統性不公平(如歷史上黑人被更多地逮捕,導致再犯預測的訓練資料中黑人的記錄比例偏高),模型會學習並強化這種偏見,而非糾正它。「垃圾進,垃圾出」的邏輯在這裡有更深刻的社會意涵。

代理特徵(Proxy Features):即使模型沒有直接使用受保護屬性(如種族),也可能透過高度相關的代理特徵間接引入偏見。例如,郵遞區號在許多國家和種族高度相關(因為歷史性的居住隔離),一個以郵遞區號作為特徵的信用模型,可能在不直接使用種族資料的情況下,產生帶有種族偏見的輸出結果。

評估資料的不代表性:如果模型在某個族群的資料上評估效果良好,但這個族群在訓練資料中被大量代表,而其他族群的資料稀少,模型對稀少族群的預測效果可能更差,但整體評估指標不會顯示出問題。

公平性的多種定義(而且它們之間存在數學上的不相容性):

- 個體公平(Individual Fairness):相似的個體應受到相似的對待。

- 群體公平(Group Fairness):不同群體的特定統計指標(如假陽性率、通過率)應相等。

- 令人困擾的是,數學上已被證明:在某些條件下,無法同時滿足所有公平性定義。「公平」在根本上是一個需要社會選擇和價值判斷的問題,而非純粹的技術問題。

應用場景

| 場景 | 隱私挑戰 | 適用技術 | 法規要求 |

|---|---|---|---|

| 醫療 AI 模型訓練 | 病歷是高敏感特種個資,跨醫院資料無法集中 | 聯邦學習 + 差分隱私 | GDPR、台灣個資法特種個資 |

| 手機鍵盤輸入學習 | 用戶輸入內容極為敏感,資料量龐大 | 本地差分隱私(Local DP)+ 聯邦學習 | 各國個資法、Apple/Google 隱私政策 |

| 人口普查資料發布 | 公開資料需可用於研究,但個人不可被識別 | 差分隱私(美國 2020 人口普查採用) | 各國統計法 |

| 信用評分模型 | 模型決策影響個人財務機會,需避免歧視 | 公平性評估 + 可解釋性(SHAP) | 台灣消費者保護法、美國 ECOA |

| 員工績效 AI 評估 | 演算法決策影響就業,需可解釋 | 模型可解釋性、人工審查 | GDPR 第 22 條(自動化決策權利) |

| 廣告精準投放 | 大規模個人行為追蹤 | 同意管理平台(CMP)、資料最小化 | GDPR、ePrivacy 指令、台灣個資法 |

| 健康資料研究 | 匿名化後資料仍有重識別風險 | k-匿名性 + l-多樣性 + 差分隱私 | 生醫研究倫理審查(IRB) |

常見誤區

誤區 1:「遵守個資法就等於做好了資料倫理,合規就夠了」

這是把「法律最低要求」和「倫理責任」混為一談的誤解。法律規定的是禁止做什麼,但倫理要求的是應該怎麼做,兩者之間往往存在很大的空間。

以徵信評分系統為例:台灣和 GDPR 的個資法規都允許金融機構使用用戶資料進行信用評估,只要取得適當的同意並說明用途。完全「合規」的信用評分模型可能:使用郵遞區號作為特徵(間接代理社經地位和種族),對特定區域的居民系統性地給出更低的信用分數,即使這些居民的真實還款能力和其他區域的人並無顯著差異。這在法律上可能合規,但在倫理上造成了系統性的不公平。

另一個維度:即使在法律允許的範圍內,企業收集了遠多於業務需要的資料(如一個天氣 App 要求存取你的通訊錄),雖然可以通過同意書讓用戶同意,但這違反了「資料最小化」的倫理原則(只收集達成目的所必要的最少量資料)。

資料倫理要求從更高的層次思考:「這樣使用資料,對被影響的人是公平的嗎?有尊重他們的自主性嗎?潛在的傷害和使用的利益相稱嗎?」這些問題沒有法律給出明確答案,需要組織內部的倫理框架和負責任的人工判斷。

誤區 2:「差分隱私加了噪音會讓資料變得沒用,不實用」

這種擔憂雖然有道理,但過於悲觀,忽視了差分隱私的設計是隨資料集規模的增大而效果更好的特性。

對於大規模統計分析,差分隱私引入的噪音相對於統計信號是微不足道的。例如,查詢「全台灣 20-30 歲女性的平均月收入」,即使在答案上加了 ±500 元的隨機噪音,對於精確到千元的政策分析而言幾乎沒有影響,但已經確保了任何個人的實際薪資資訊不會被洩漏。美國人口普查局採用差分隱私後,雖然在非常細粒度的地理層級(如單個街區)的資料精確度有所下降,但在州、縣級別的統計數字幾乎沒有受到影響。

差分隱私真正「貴」的場景是:需要對同一個資料集做大量不同的查詢(因為每次查詢都消耗隱私預算 ε,如果做了太多查詢,累積的 ε 就很大,隱私保護減弱),或者需要在非常小的資料集上做精細的個體級查詢。

實際工程中,差分隱私可以在不犧牲太多實用性的前提下有效部署:Apple 和 Google 都在生產系統中大規模使用了本地差分隱私;微軟 Azure 和 Google Cloud 都提供了差分隱私的 API 和工具庫,讓實作的門檻大幅降低。關鍵是根據使用場景合理設計隱私預算分配,而不是簡單地認為「加了噪音就沒用」。

誤區 3:「AI 模型是中立的,它只看數字,不會有歧視」

這個誤區是對 AI 工作原理的根本性誤解,也是演算法偏見問題在社會上造成危害的重要原因之一:因為人們相信「算法是中立的」,反而更容易放棄對算法輸出的批判性審視。

AI 模型本質上是從訓練資料中學習統計規律的系統。如果訓練資料中包含了人類社會的偏見(而現實中幾乎所有大規模的歷史資料都包含了或多或少的偏見),模型就會學習並複製這些偏見。更危險的是,AI 系統有時會以人類難以察覺的方式放大偏見——因為模型的預測被包裝在「客觀的數字」之下,人們更傾向於相信和接受,反而缺乏了對人類直覺決策的那種天然的挑戰和審查。

一個著名的例子:Amazon 在 2014-2017 年使用 AI 系統篩選求職履歷,模型因為訓練資料中的工程師以男性為主,學習到了「含有女性相關關鍵詞的履歷(如女子大學的校名)得分更低」的模式,實質上歧視了女性申請者。這個問題被發現後,Amazon 最終放棄了這個系統。

「演算法中立」的假設是危險的,因為它會造成「誰來審查算法」的責任真空。正確的態度是:AI 系統在部署前應該進行系統性的公平性審計(Fairness Audit),在部署後應持續監控不同群體的模型效果差異,並建立讓受影響的個人能夠挑戰算法決策的機制(GDPR 第 22 條中的「不受自動化決策影響的權利」)。

小練習

練習 1:識別隱私風險

某醫療研究機構要發布一份去識別化的患者資料集,供外部研究人員使用。資料集包含以下欄位:

| 欄位 | 示例值 | 類型 |

|---|---|---|

| 患者編號 | P-10342 | 隨機編號(已替換真實ID) |

| 出生年月 | 1978-05 | 準識別符 |

| 性別 | 女 | 準識別符 |

| 居住縣市 | 台北市大安區 | 準識別符 |

| 職業類別 | 教育/學術 | 準識別符 |

| 主要診斷 | 乳癌第二期 | 敏感屬性 |

| 就診日期 | 2023-03-15 | 準識別符 |

| 治療費用區間 | 50-80萬 | 準識別符 |

請回答:(1)這份資料目前已做了什麼隱私保護措施?(2)還存在哪些重識別風險?(3)應增加哪些保護措施?

練習 2:評估演算法偏見

一家銀行部署了 AI 信用評分系統,以下是在測試集上按性別分組的評估結果:

| 群體 | 申請件數 | 通過率 | 假陽性率(好人被拒) | 假陰性率(壞人被批) |

|---|---|---|---|---|

| 男性 | 10,000 | 68% | 12% | 8% |

| 女性 | 10,000 | 52% | 20% | 5% |

- 從這些數據中,你能觀察到哪些潛在的偏見問題?

- 這個偏見可能來自哪些原因?(列出至少 3 個可能的原因)

- 作為這家銀行的倫理合規負責人,你會採取哪些緊急行動?